機器學習知識點整理(三)

十一、深度學習基礎

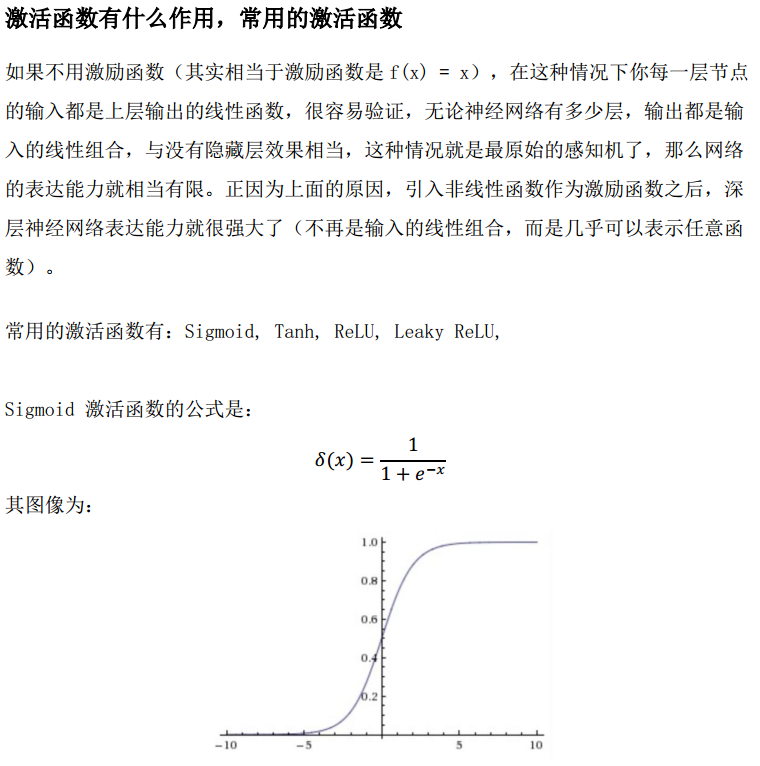

1.為什麼必須在神經網絡中引入非線性?

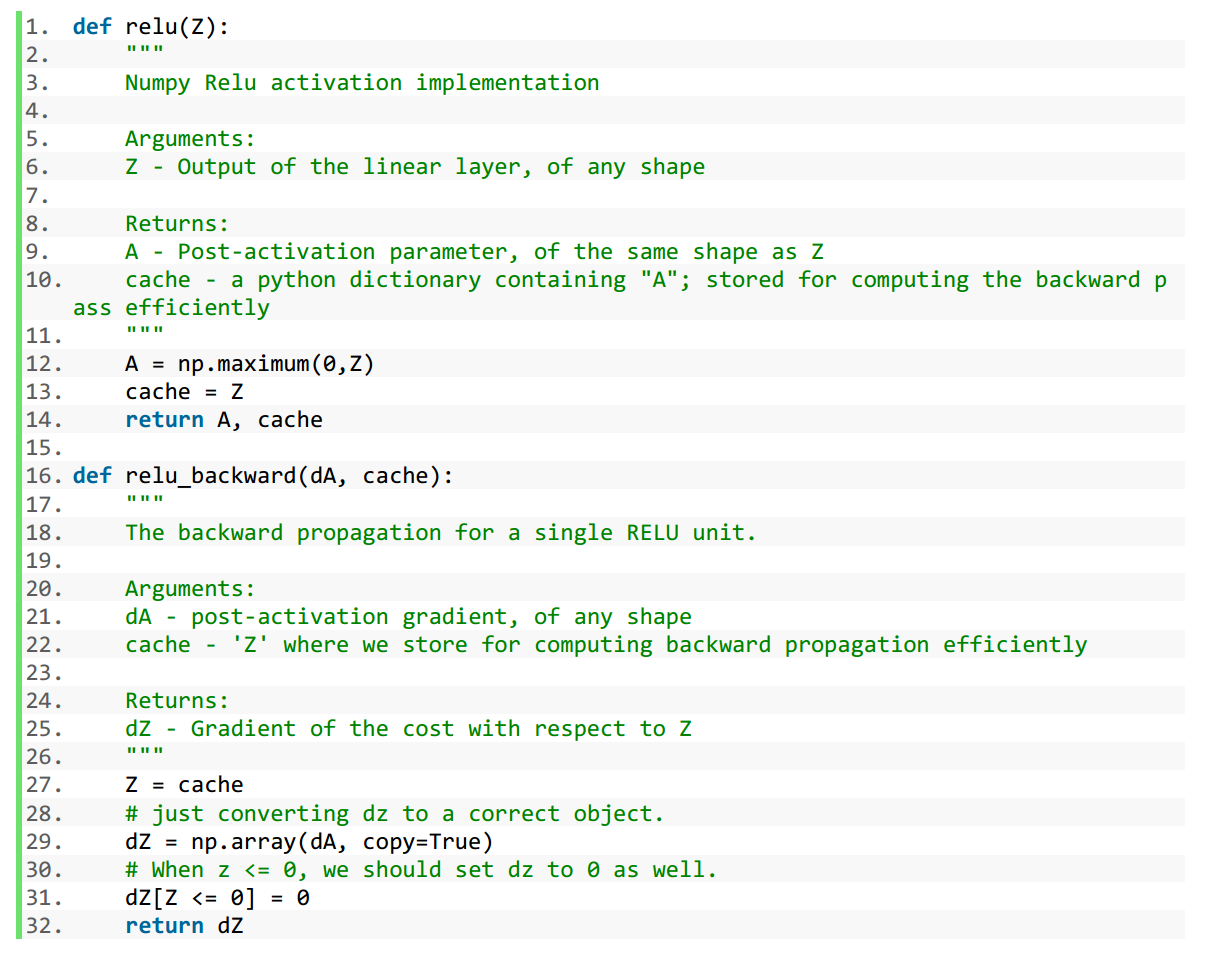

2.ReLU在零點不可導,那麼在反向傳播中怎麼處理?

ReLU雖然在零點不可導,但是我們在做反向傳播的計算時,對ReLu這個函數的導數分情況討論,即ReLU在零點時人為地給它賦予一個導數,比如0或者1。例如在下面的ReLU的反向傳播函數實現中,將ReLU在零點位置的導數設置為0。

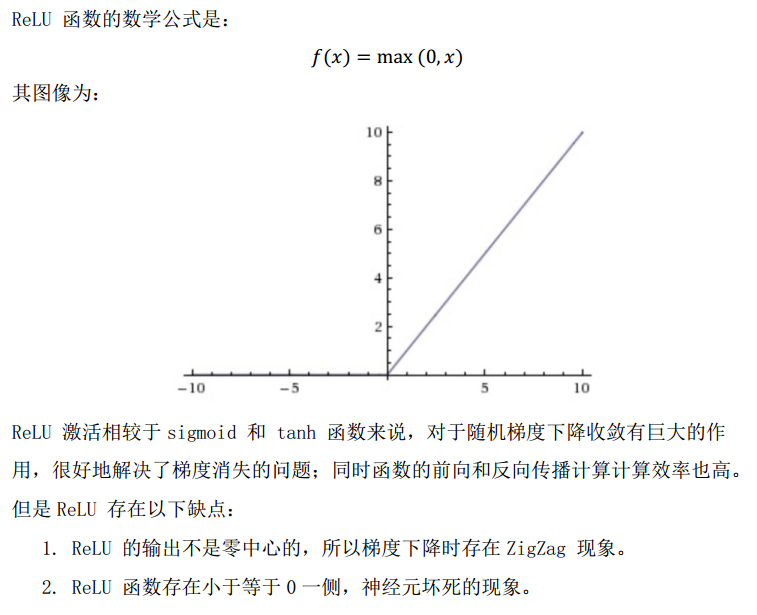

3.ReLu有哪些優缺點

優點:

1). 使用 ReLU 的 SGD 算法的收斂速度比 sigmoid 和 tanh 快;

2.) 在 x > 0 上,不會出現梯度飽和,梯度消失的問題。

3.) 計算複雜度低,不需要進行指數運算,只要一個閾值(0)就可以得到激活值。

缺點:

1.) ReLU 的輸出不是 0 均值的,它將小於 0 的值都置為 0; 使得所有參數的更新方

向都相同,導致了 ZigZag 現象。

2.) Dead ReLU Problem (ReLU 神經元壞死現象):某些神經元可能永遠不被激活,

導致相應參數永遠不會被更新(在負數部分,梯度為 0)

3.) ReLU 不會對數據做幅度壓縮,所以數據的幅度會隨着模型層數的增加不斷擴

張。

註: ZigZag 現象指的是,模型中所有的參數在一次梯度更新的過程中,更新方向相

同,即同為正或者同為負。這就導致了梯度更新圖像呈現 Z 字形,進而導致梯度更新

效率比較低。

4.Batch Normalization解決了什麼問題

5.

6.

7.

8.

9.

10.

11.

十二、CV

1.

2.

3.

4.

5.

6.

7.

8.

9.