机器学习知识点整理(三)

十一、深度学习基础

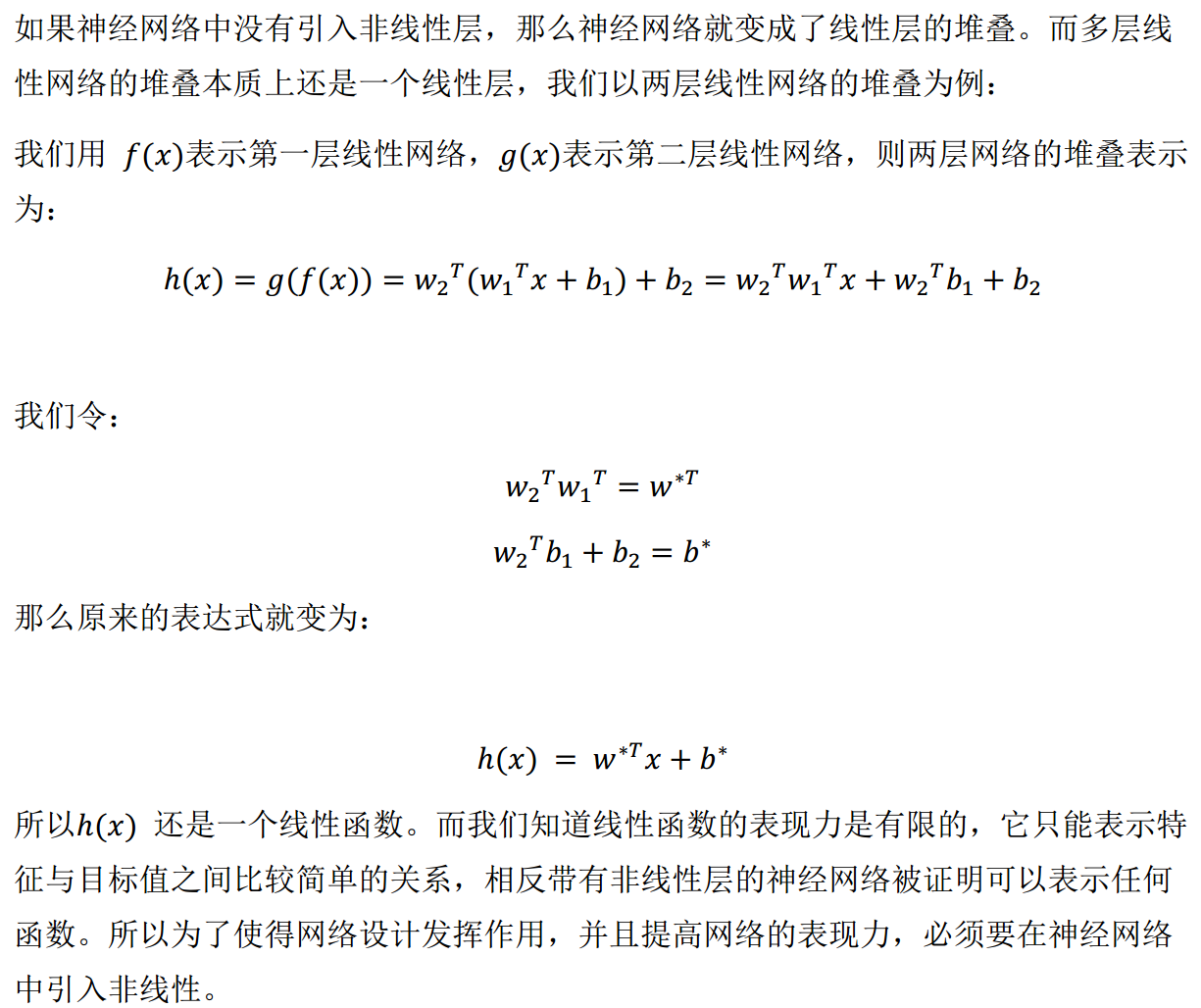

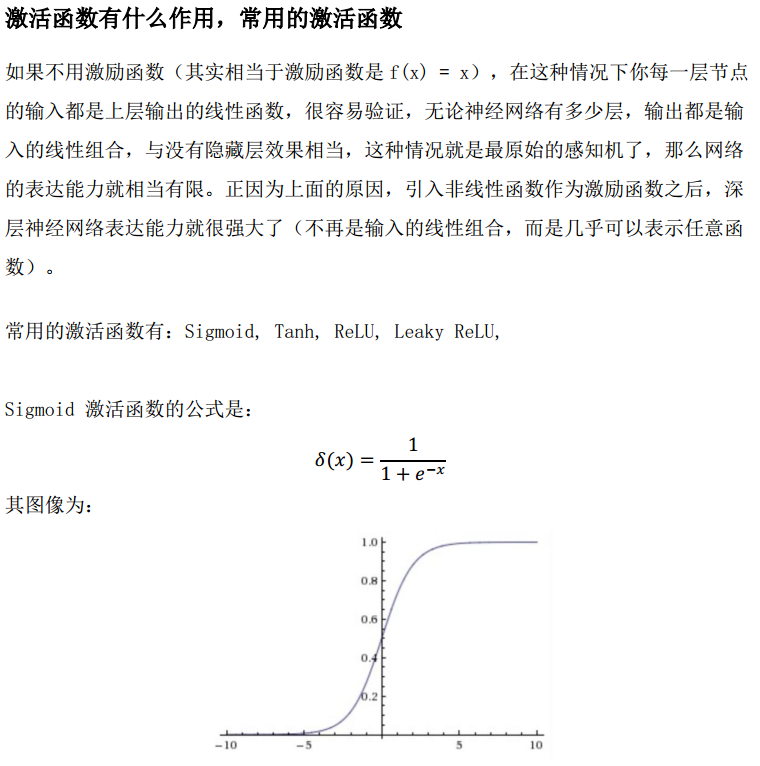

1.为什么必须在神经网络中引入非线性?

2.ReLU在零点不可导,那么在反向传播中怎么处理?

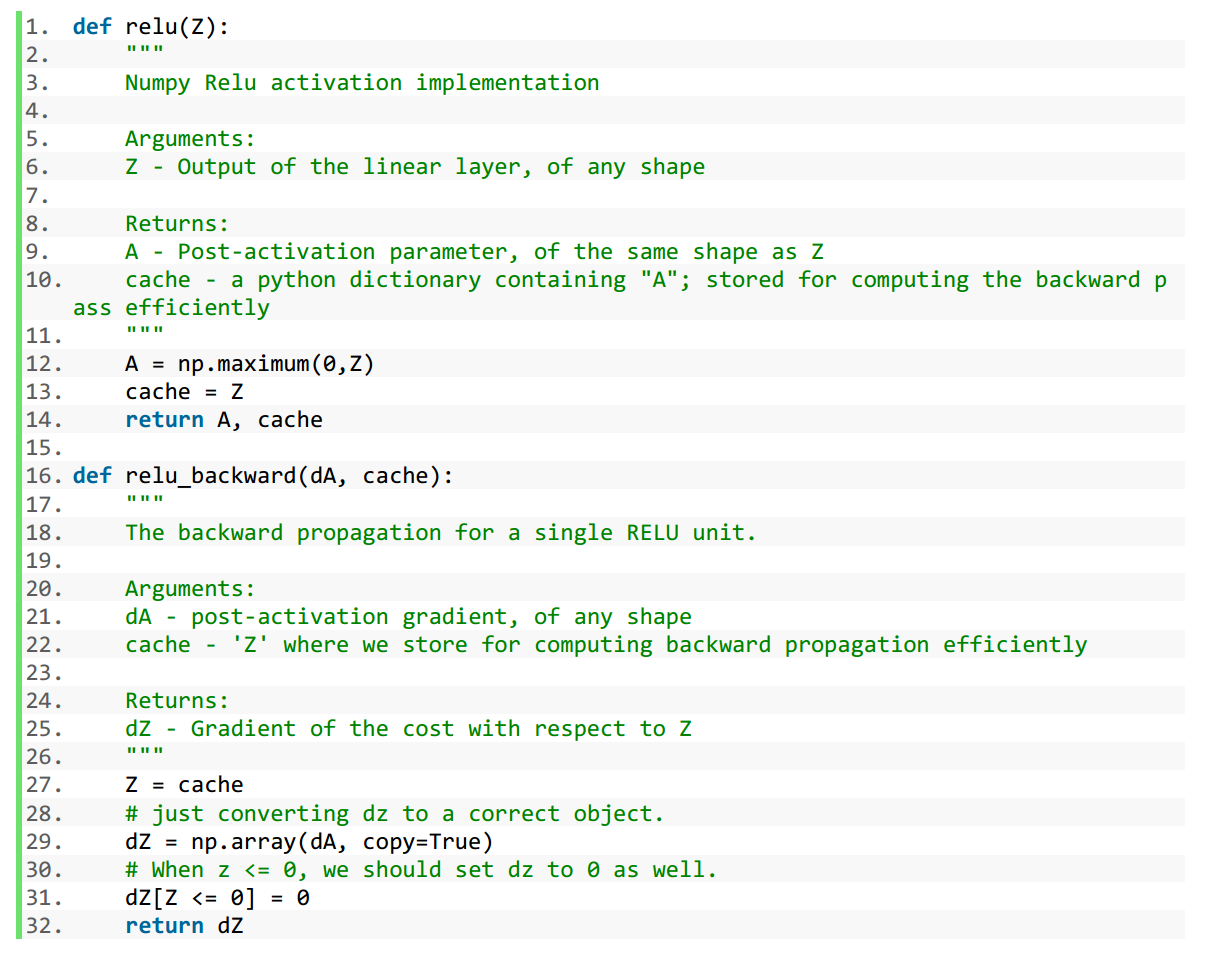

ReLU虽然在零点不可导,但是我们在做反向传播的计算时,对ReLu这个函数的导数分情况讨论,即ReLU在零点时人为地给它赋予一个导数,比如0或者1。例如在下面的ReLU的反向传播函数实现中,将ReLU在零点位置的导数设置为0。

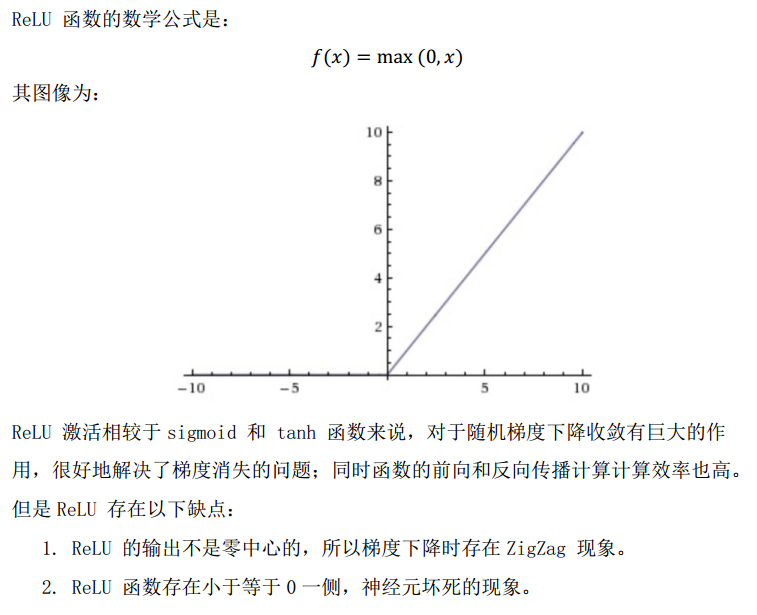

3.ReLu有哪些优缺点

优点:

1). 使用 ReLU 的 SGD 算法的收敛速度比 sigmoid 和 tanh 快;

2.) 在 x > 0 上,不会出现梯度饱和,梯度消失的问题。

3.) 计算复杂度低,不需要进行指数运算,只要一个阈值(0)就可以得到激活值。

缺点:

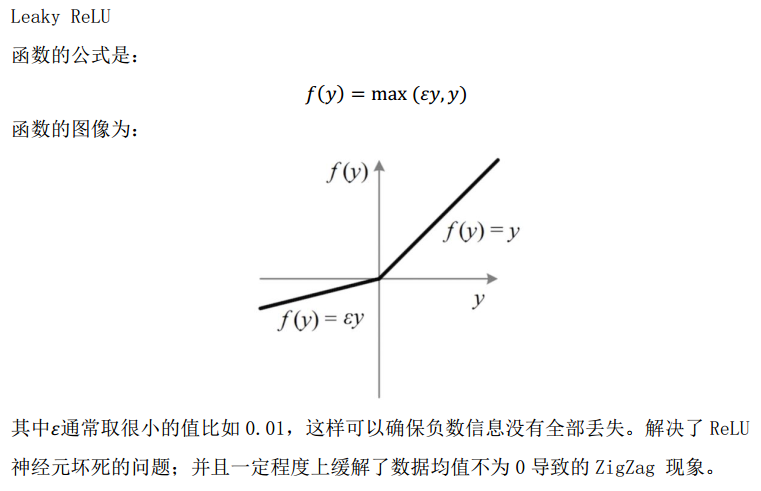

1.) ReLU 的输出不是 0 均值的,它将小于 0 的值都置为 0; 使得所有参数的更新方

向都相同,导致了 ZigZag 现象。

2.) Dead ReLU Problem (ReLU 神经元坏死现象):某些神经元可能永远不被激活,

导致相应参数永远不会被更新(在负数部分,梯度为 0)

3.) ReLU 不会对数据做幅度压缩,所以数据的幅度会随着模型层数的增加不断扩

张。

注: ZigZag 现象指的是,模型中所有的参数在一次梯度更新的过程中,更新方向相

同,即同为正或者同为负。这就导致了梯度更新图像呈现 Z 字形,进而导致梯度更新

效率比较低。

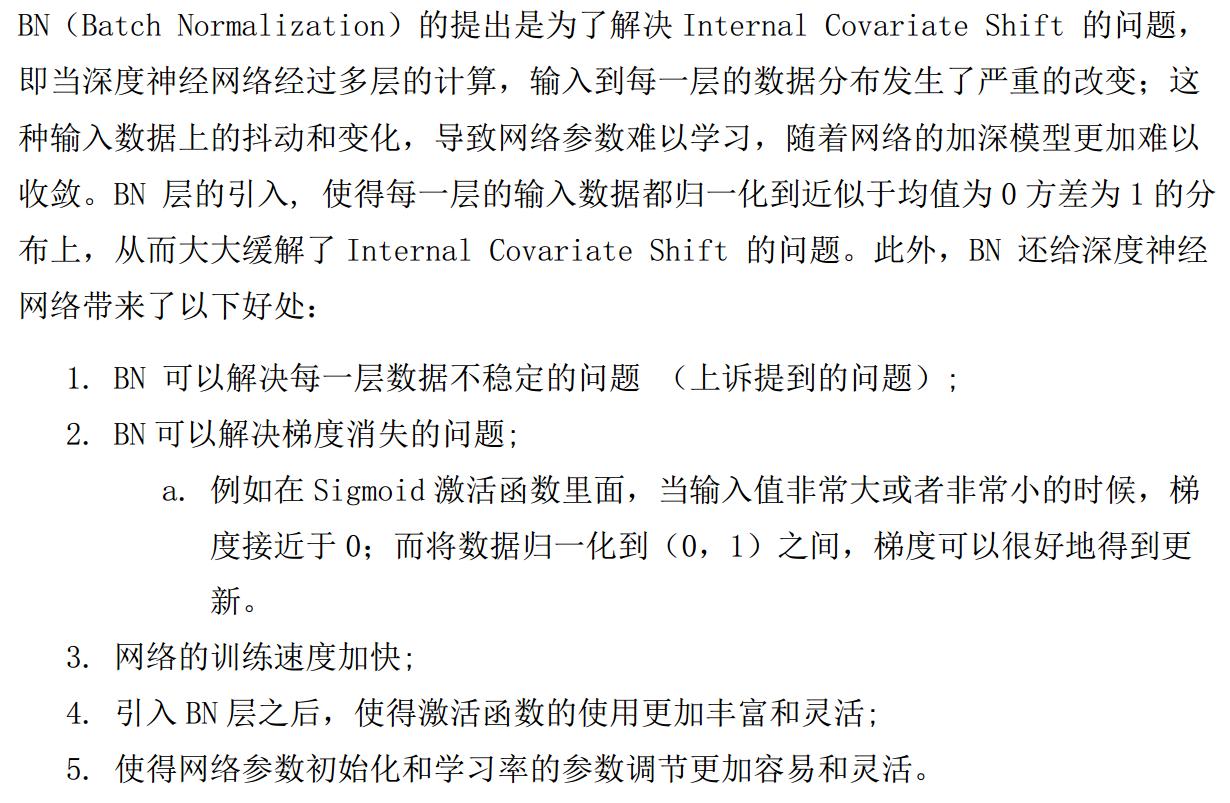

4.Batch Normalization解决了什么问题

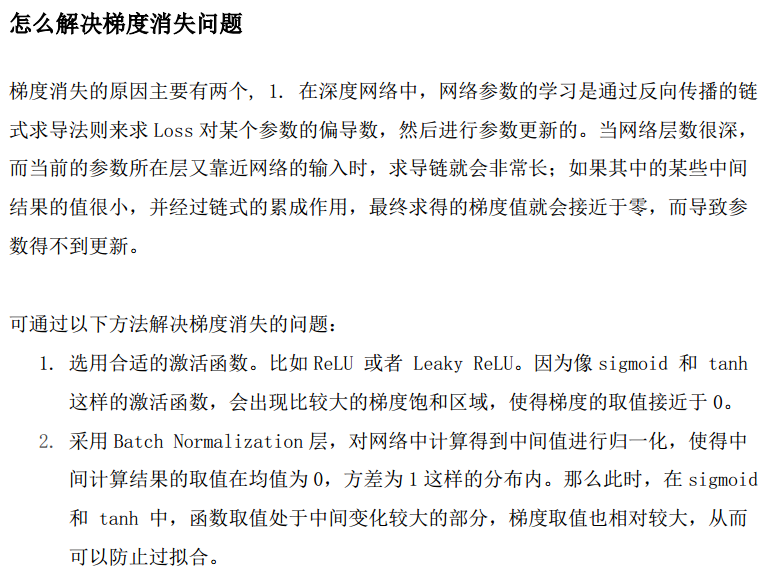

5.

6.

7.

8.

9.

10.

11.

十二、CV

1.

2.

3.

4.

5.

6.

7.

8.

9.