消息隊列之如何保證消息的可靠傳輸

1.1 RQ

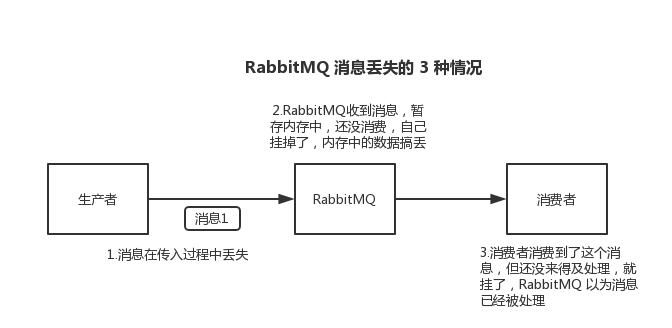

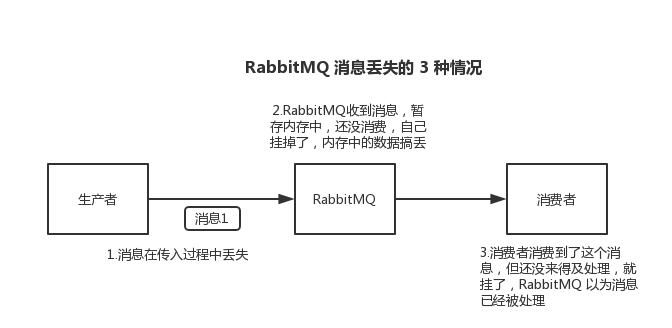

對於RQ來說在消息傳輸的過程中主要有三塊地方可能發生消息丟失:

- 生產者

- RQ

- 消費者

1.1.1 RQ消費者發生消息丟失

此時可以選擇用 RabbitMQ 提供的事務功能,就是生產者發送數據之前開啟 RabbitMQ 事務 channel.txSelect ,然後發送消息,如果消息沒有成功被 RabbitMQ 接收到,那麼生產者會收到異常報錯,此時就可以回滾事務 channel.txRollback ,然後重試發送消息;如果收到了消息,那麼可以提交事務 channel.txCommit 。

// 開啟事務

channel.txSelect

try {

// 這裡發送消息

} catch (Exception e) {

channel.txRollback

// 這裡再次重發這條消息

}

// 提交事務

channel.txCommit

但是問題是,RabbitMQ 事務機制(同步)一搞,基本上吞吐量會下來,因為太耗性能。

所以一般來說,如果你要確保說寫 RabbitMQ 的消息別丟,可以開啟 confirm 模式,在生產者那裡設置開啟 confirm 模式之後,你每次寫的消息都會分配一個唯一的 id,然後如果寫入了 RabbitMQ 中,RabbitMQ 會給你回傳一個 ack 消息,告訴你說這個消息 ok 了。如果 RabbitMQ 沒能處理這個消息,會回調你的一個 nack 介面,告訴你這個消息接收失敗,你可以重試。而且你可以結合這個機制自己在記憶體里維護每個消息 id 的狀態,如果超過一定時間還沒接收到這個消息的回調,那麼你可以重發。

事務機制和 confirm 機制最大的不同在於,事務機制是同步的,你提交一個事務之後會阻塞在那兒,但是 confirm 機制是非同步的,你發送個消息之後就可以發送下一個消息,然後那個消息 RabbitMQ 接收了之後會非同步回調你的一個介面通知你這個消息接收到了。

所以一般在生產者這塊避免數據丟失,都是用 confirm 機制的。

1.1.2 RQ本身出問題宕機

就是 RabbitMQ 自己弄丟了數據,這個你必須開啟 RabbitMQ 的持久化,就是消息寫入之後會持久化到磁碟,哪怕是 RabbitMQ 自己掛了,恢復之後會自動讀取之前存儲的數據,一般數據不會丟。除非極其罕見的是,RabbitMQ 還沒持久化,自己就掛了,可能導致少量數據丟失,但是這個概率較小。

設置持久化有兩個步驟:

- 創建 queue 的時候將其設置為持久化

這樣就可以保證 RabbitMQ 持久化 queue 的元數據,但是它是不會持久化 queue 里的數據的。

- 第二個是發送消息的時候將消息的 deliveryMode 設置為 2

就是將消息設置為持久化的,此時 RabbitMQ 就會將消息持久化到磁碟上去。

必須要同時設置這兩個持久化才行,RabbitMQ 哪怕是掛了,再次重啟,也會從磁碟上重啟恢復 queue,恢復這個 queue 里的數據。

注意,哪怕是你給 RabbitMQ 開啟了持久化機制,也有一種可能,就是這個消息寫到了 RabbitMQ 中,但是還沒來得及持久化到磁碟上,結果不巧,此時 RabbitMQ 掛了,就會導致記憶體里的一點點數據丟失。

所以,持久化可以跟生產者那邊的 confirm 機制配合起來,只有消息被持久化到磁碟之後,才會通知生產者 ack 了,所以哪怕是在持久化到磁碟之前,RabbitMQ 掛了,數據丟了,生產者收不到 ack ,你也是可以自己重發的。

1.1.3 消費者丟失消息

RabbitMQ 如果丟失了數據,主要是因為你消費的時候,剛消費到,還沒處理,結果進程掛了,比如重啟了,那麼就尷尬了,RabbitMQ 認為你都消費了,這數據就丟了。

這個時候得用 RabbitMQ 提供的 ack 機制,簡單來說,就是你必須關閉 RabbitMQ 的自動 ack ,可以通過一個 api 來調用就行,然後每次你自己程式碼里確保處理完的時候,再在程式里 ack 一把。這樣的話,如果你還沒處理完,不就沒有 ack 了?那 RabbitMQ 就認為你還沒處理完,這個時候 RabbitMQ 會把這個消費分配給別的 consumer 去處理,消息是不會丟的。

1.1.4 RQ總結

2.1 Kafka

跟RQ一樣,Kafka發生消息丟失的地方也大致是這三個地方:生產者,Kafka,消費者。

2.1.1 Kafka生產者

一般我們為了放著生產者丟失消息一般在生產環境中這樣設置:

- 在 producer 端設置 acks=all :這個是要求每條數據,必須是寫入所有 replica 之後,才能認為是寫成功了。

- 在 producer 端設置 retries=MAX (很大很大很大的一個值,無限次重試的意思):這個是要求一旦寫入失敗,就無限重試,卡在這裡了。

這樣就可以保證一定不會丟,因為要求的是:你的 leader 接收到消息,所有的 follower 都同步到了消息之後,才認為本次寫成功了。如果沒滿足這個條件,生產者會自動不斷的重試,重試無限次。

2.1.2 Kafka弄丟了消息

這塊比較常見的一個場景,就是 Kafka 某個 broker 宕機,然後重新選舉 partition 的 leader。大家想想,要是此時其他的 follower 剛好還有些數據沒有同步,結果此時 leader 掛了,然後選舉某個 follower 成 leader 之後,不就少了一些數據?這就丟了一些數據啊。

生產環境也遇到過,我們也是,之前 Kafka 的 leader 機器宕機了,將 follower 切換為 leader 之後,就會發現說這個數據就丟了。

所以此時一般是要求起碼設置如下 4 個參數:

- 給 topic 設置 replication.factor 參數:這個值必須大於 1,要求每個 partition 必須有至少 2 個副本。

- 在 Kafka 服務端設置 min.insync.replicas 參數:這個值必須大於 1,這個是要求一個 leader 至少感知到有至少一個 follower 還跟自己保持聯繫,沒掉隊,這樣才能確保 leader 掛了還有一個 follower 吧。

- 在 producer 端設置 acks=all :這個是要求每條數據,必須是寫入所有 replica 之後,才能認為是寫成功了。

- 在 producer 端設置 retries=MAX (很大很大很大的一個值,無限次重試的意思):這個是要求一旦寫入失敗,就無限重試,卡在這裡了。

我們生產環境就是按照上述要求配置的,這樣配置之後,至少在 Kafka broker 端就可以保證在 leader 所在 broker 發生故障,進行 leader 切換時,數據不會丟失。

2.1.3 消費端弄丟了數據

唯一可能導致消費者弄丟數據的情況,就是說,你消費到了這個消息,然後消費者那邊自動提交了 offset,讓 Kafka 以為你已經消費好了這個消息,但其實你才剛準備處理這個消息,你還沒處理,你自己就掛了,此時這條消息就丟咯。

這不是跟 RabbitMQ 差不多嗎,大家都知道 Kafka 會自動提交 offset,那麼只要關閉自動提交 offset,在處理完之後自己手動提交 offset,就可以保證數據不會丟。但是此時確實還是可能會有重複消費,比如你剛處理完,還沒提交 offset,結果自己掛了,此時肯定會重複消費一次,自己保證冪等性就好了。

生產環境碰到的一個問題,就是說我們的 Kafka 消費者消費到了數據之後是寫到一個記憶體的 queue 里先緩衝一下,結果有的時候,你剛把消息寫入記憶體 queue,然後消費者會自動提交 offset。然後此時我們重啟了系統,就會導致記憶體 queue 里還沒來得及處理的數據就丟失了。