Double Graph Based Reasoning for Document-level Relation Extraction 論文閱讀 EMNLP 2020

Background

程式碼鏈接 //github.com/DreamInvoker/GAIN,其性能相較 ACL 2020中的文檔級關係抽取模型LSR有一定的提升,其能夠有提升的主要原因在於兩點:

- 雙圖

- mention-level Graph: model complex interaction among mentions across sentences with heterogeneous mention-level graph (hMG) 異構圖相較之前一些構建同質圖做特徵傳播的模型,使用異質圖可以融合更複雜的特徵;

- Entity-level Graph: merge mentions that infer to the same entity;

- A novel path reasoning among entities.新穎的路徑推理機制

Model

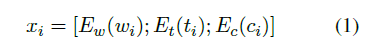

- Encoding Module

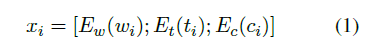

以句子為單位,使用LSTM/BERT對文本進行編碼,以LSTM為例,將每個單詞的詞向量、實體類型編碼(如果單詞不屬於實體提及就設為None)、共指編碼拼接作為輸入:

-

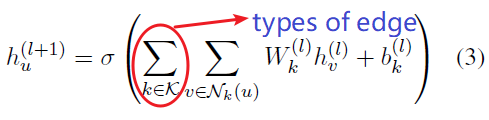

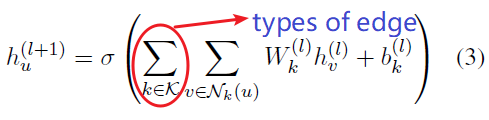

Mention-level graph 異構圖-提及圖特徵聚合

兩種節點:提及節點、文檔節點

三種類型邊:- Intra-Entity Edge: 連接同一實體提及;

- Inter-Entity Edge:同一句話下的不同實體提及;

- Document Edge:所有的提及都連接到文檔節點(話說可以解決長距離的依賴問題?因為所有的提及節點都可以通過文檔節點和其餘的提及節點相連接。以文檔節點為軸心,兩個提及節點之間的距離最長為2)可以算做是小技巧/小創新?

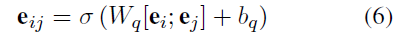

Aggregate the features from neighbors:

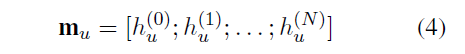

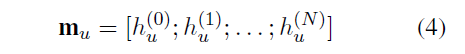

Concatenate hidden states of each layer:(可借鑒,加個注意力??)

-

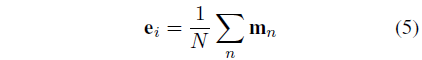

Entity-level graph 實體圖關係推理

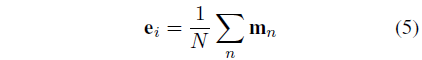

在Entity-level graph(EG)中忽略掉了hMG中的文檔節點,同一實體的不同提及被歸為實體節點:

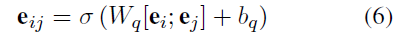

將有關係的兩個實體相連(若兩個實體的提及之間有關係<即有相連邊>則這兩個實體就有關係),從而得到EG中的邊。

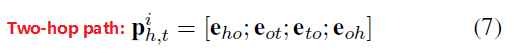

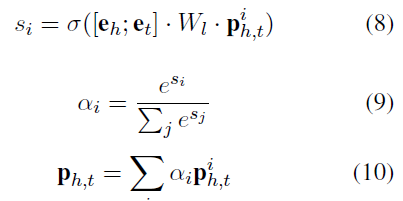

基於上述邊的表示,以實體作為中介節點,從頭實體到尾實體之間的第條路徑表示為:

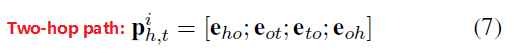

由於兩個實體間的路徑可能有多條,所以需要有對多條路徑的融合機制,GAIN採用注意機制,利用作為query,融合和之間不同路徑的資訊。

在實體圖關係推理模組中,一個實體通過融合其提及的資訊來表示,這些提及資訊通常在多個句子中,因此這種提及向量的融合方式實現了一定程度上的跨句資訊傳播。

此外,潛在的推理邏輯由實體間的不同路徑來建模。然後將它們與注意機制相結合,這樣就可以根據潛在的邏輯推理鏈來預測關係。(遠距離建模實體關係,唉,應該是借鑒了2018的walk-based model) -

Classification Module

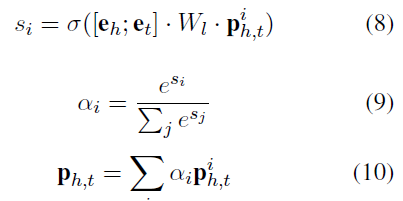

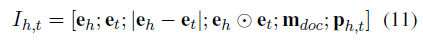

對於每個實體對,連接三種表示作為關係向量的表示:- 實體圖中導出的頭尾實體表示和,使用比較運算(comparing operation)增強特徵,即兩個實體表示之間差的絕對值。

- MG中的文檔節點表示,有助於聚合跨句資訊,提供文檔感知表示;

- 在實體圖(EG)中得到的綜合推理路徑向量

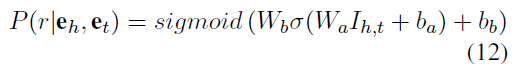

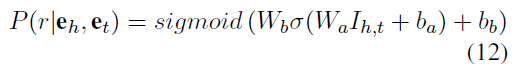

我們定義這個任務為一個多標籤分類任務:

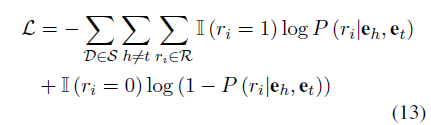

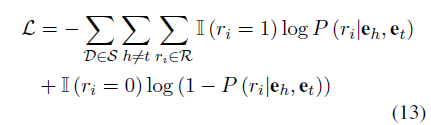

Classification loss:

Experiment

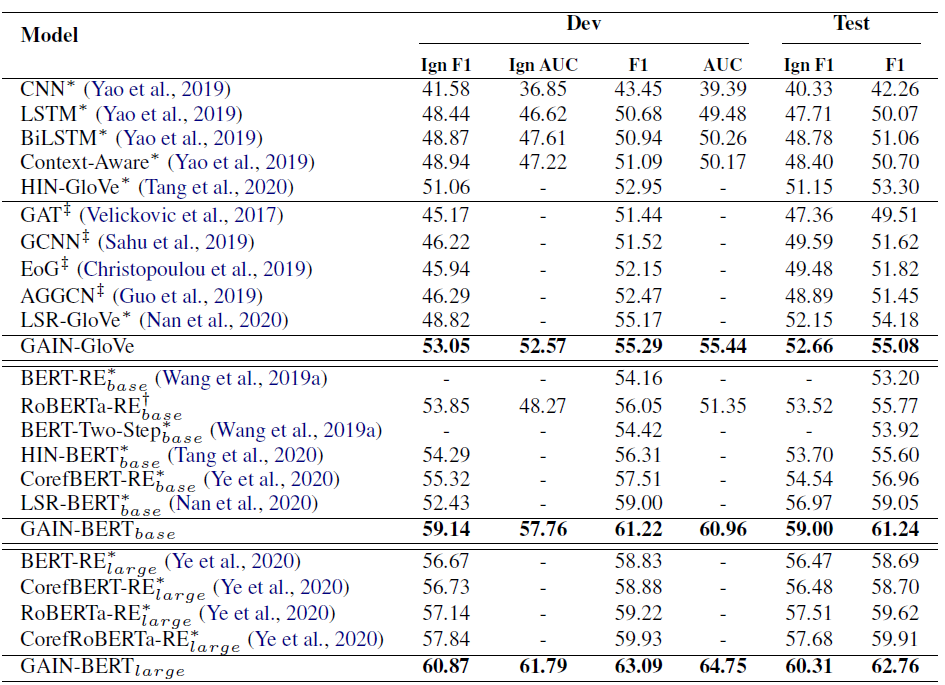

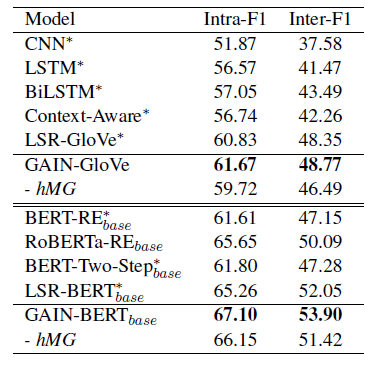

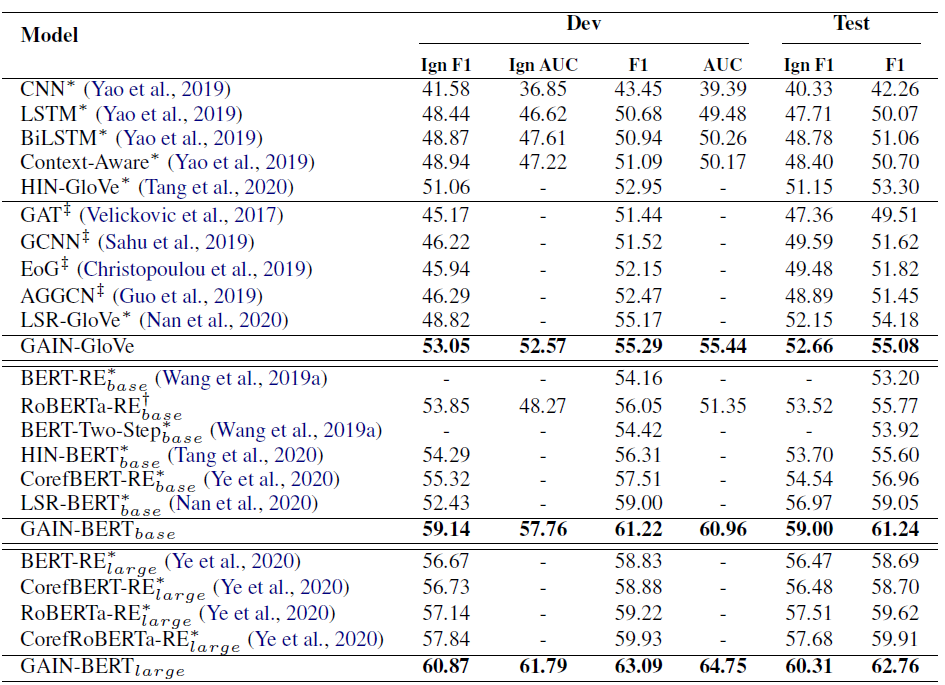

- 實驗結果

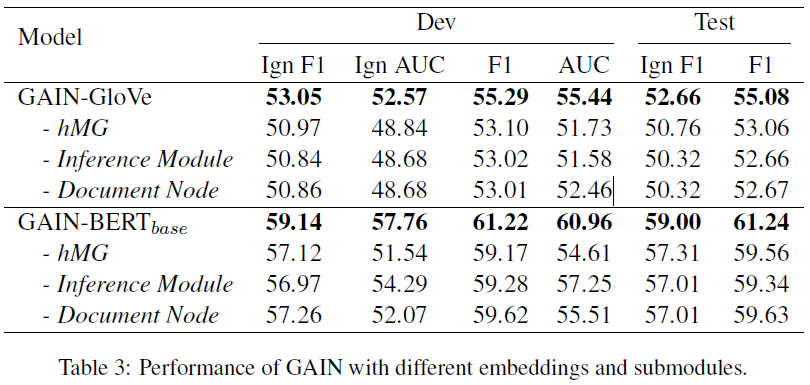

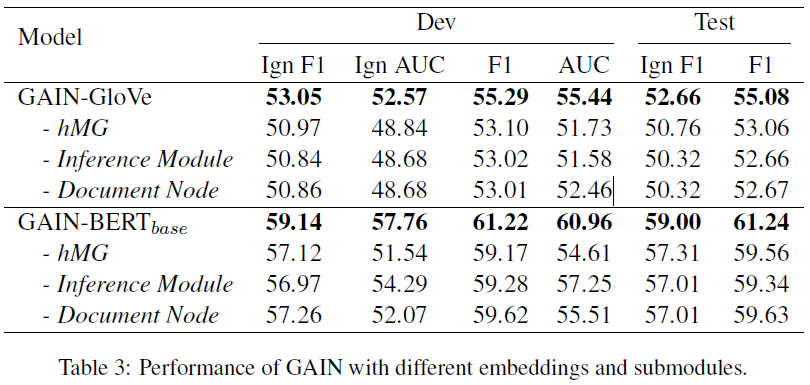

- 消融實驗

也就是三個創新點:

1.異質圖 2.路徑推理機制 3. document node - 分析和討論

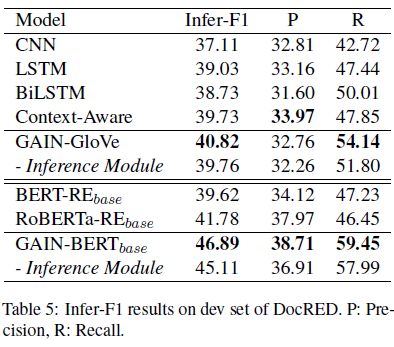

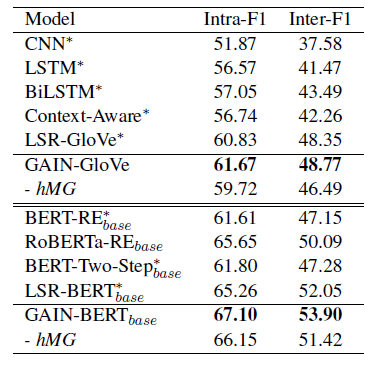

- 跨句關係性能表現

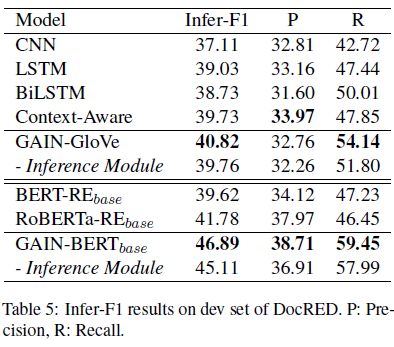

hMG對於跨句間的關係事實有重要作用。 - Infer-F1,which only consider relations that engaged in the relational reasoning process.

推理機制對於捕獲潛在的推理鏈上實體關係事實有著重要作用。

- 跨句關係性能表現