Kubernetes全棧架構師(Kubeadm高可用安裝k8s集群)–學習筆記

- 2021 年 7 月 10 日

- 筆記

- 【014】Kubernetes全棧架構師

目錄

- k8s高可用架構解析

- Kubeadm基本環境配置

- Kubeadm系統及內核升級

- Kubeadm基本組件安裝

- Kubeadm高可用組件安裝

- Kubeadm集群初始化

- 高可用Master及Token過期處理

- Kubeadm Node及Calico節點配置

- Dashboard&Metrics Server安裝

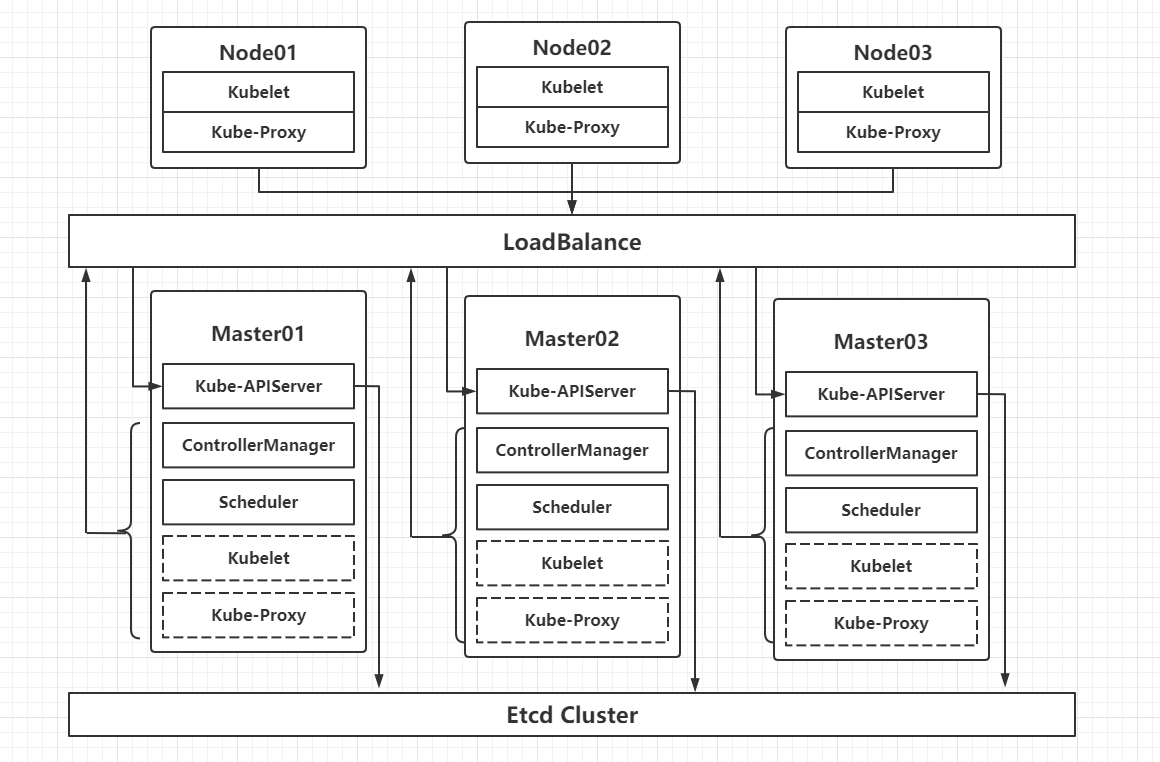

k8s高可用架構解析

- Etcd Cluster:鍵值數據庫,存放k8s的數據,比如我們創建的資源,所做的變更

- Master:控制節點,控制整個集群

- Node:主要用來跑pod和容器

- Kube-APIServer:它是整個k8s的控制大腦,所有的流量都會經過APIServer

- ControllerManager:集群的控制器

- Scheduler:集群的調度器,控制pod調度到哪一個node節點

- Load Balancer:負載均衡,一般使用nginx + keepalived,或者keepalived + haproxy,如果有硬件資源如f5,就不需要Load Balancer,通過虛擬IP連接

Kubeadm基本環境配置

Kubeadm 是官方推薦的安裝方式,但是生產環境推薦使用二進制的方式安裝

Kubeadm 證書的有效期是一年,因為官方建議運行一年的過程中必須要升級一次

高可用Kubernetes集群規劃

| 主機名 | IP地址 | 說明 |

|---|---|---|

| k8s-master01 ~ 03 | 192.168.232.128 ~ 130 | master節點 * 3 |

| k8s-master-lb | 192.168.232.236 | keepalived虛擬IP |

| k8s-node01 ~ 02 | 192.168.232.131 ~ 132 | worker節點 * 2 |

| 配置信息 | 備註 |

|---|---|

| Pod網段 | 172.168.0.0/12 |

| Service網段 | 10.96.0.0/12 |

VIP(虛擬IP)不要和公司內網IP重複,首先去ping一下,不通才可用。VIP需要和主機在同一個局域網內

[root@localhost ~]# ping 192.168.232.236

PING 192.168.232.236 (192.168.232.236) 56(84) bytes of data.

From 192.168.232.128 icmp_seq=1 Destination Host Unreachable

From 192.168.232.128 icmp_seq=2 Destination Host Unreachable

From 192.168.232.128 icmp_seq=3 Destination Host Unreachable

公有雲上搭建VIP是公有雲的負載均衡的IP,比如阿里雲的內網SLB的地址,騰訊雲內網ELB的地址

基本環境配置

- 環境搭建

- 靜態ip設置

- 節點配置

環境搭建

不要使用帶中文的服務器和克隆的虛擬機

安裝虛擬機://www.cnblogs.com/mr-xiong/p/12468280.html

下載centos-7鏡像://zhuanlan.zhihu.com/p/104118123

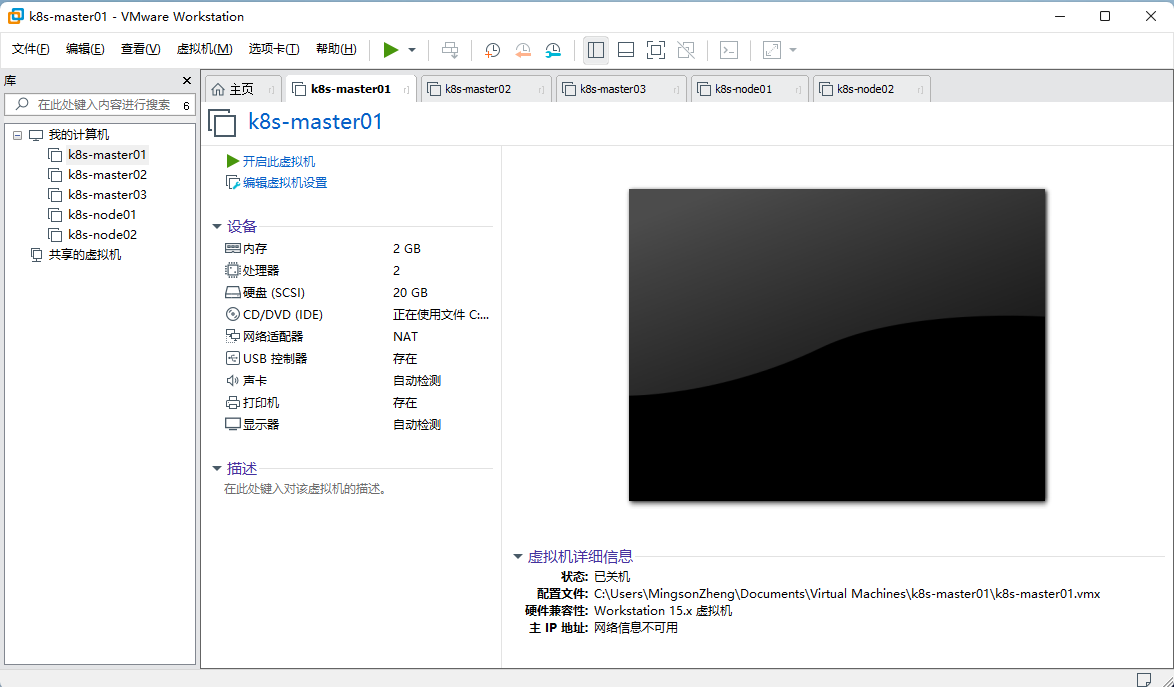

三台master節點,兩台node節點,每台虛擬機分配2核2G,存儲使用20G硬盤

安裝完成後啟動並通過Xshell 7連接五台虛擬機

Xshell 7下載地址://downloadly.net/2020/15/4832/03/xmanager/01/?#/4832-netsaran-122140071106.html

使用Xshell 7可以同時發送命令到所有會話,菜單欄–工具–發送鍵輸入到所有會話

通過 VMware 菜單欄編輯,虛擬網絡編輯器查看子網地址,192.168.232.0

靜態ip設置

打開目錄

cd /etc/sysconfig/network-scripts

修改文件 ifcfg-ens33

#修改BOOTPROTO為static

#BOOTPROTO=dhcp

BOOTPROTO=static

#修改ONBOOT為yes

ONBOOT=yes

IPADDR=192.168.232.128

GATEWAY=192.168.232.2

NETMASK=255.255.255.0

DNS1=114.114.114.114

DNS2=8.8.8.8

重啟網絡服務

service network restart

查看當前IP地址

ip a

根據集群規劃分別設置五台虛擬機靜態ip,設置完成後使用 Xshell 7 連接到五台虛擬機

Xshell 7 切換tab快捷鍵:ctrl + tab

節點配置

所有節點配置hosts,修改/etc/hosts如下:

vim /etc/hosts

127.0.0.1 localhost localhost.localdomain localhost4 localhost4.localdomain4

::1 localhost localhost.localdomain localhost6 localhost6.localdomain6

192.168.232.128 k8s-master01

192.168.232.129 k8s-master02

192.168.232.130 k8s-master03

192.168.232.236 k8s-master-lb # 如果不是高可用集群,該IP為Master01的IP

192.168.232.131 k8s-node01

192.168.232.132 k8s-node02

CentOS 7安裝yum源如下:

curl -o /etc/yum.repos.d/CentOS-Base.repo //mirrors.aliyun.com/repo/Centos-7.repo

yum install -y yum-utils device-mapper-persistent-data lvm2

yum-config-manager --add-repo //mirrors.aliyun.com/docker-ce/linux/centos/docker-ce.repo

cat <<EOF > /etc/yum.repos.d/kubernetes.repo

[kubernetes]

name=Kubernetes

baseurl=//mirrors.aliyun.com/kubernetes/yum/repos/kubernetes-el7-x86_64/

enabled=1

gpgcheck=1

repo_gpgcheck=1

gpgkey=//mirrors.aliyun.com/kubernetes/yum/doc/yum-key.gpg //mirrors.aliyun.com/kubernetes/yum/doc/rpm-package-key.gpg

EOF

sed -i -e '/mirrors.cloud.aliyuncs.com/d' -e '/mirrors.aliyuncs.com/d' /etc/yum.repos.d/CentOS-Base.repo

必備工具安裝

yum install wget jq psmisc vim net-tools telnet yum-utils device-mapper-persistent-data lvm2 git -y

所有節點關閉防火牆、selinux、dnsmasq、swap。服務器配置如下:

systemctl disable --now firewalld

systemctl disable --now dnsmasq

systemctl disable --now NetworkManager

setenforce 0

sed -i 's#SELINUX=enforcing#SELINUX=disabled#g' /etc/sysconfig/selinux

sed -i 's#SELINUX=enforcing#SELINUX=disabled#g' /etc/selinux/config

查看config文件,SELINUX被設為disabled

[root@localhost ~]# cat /etc/selinux/config

# This file controls the state of SELinux on the system.

# SELINUX= can take one of these three values:

# enforcing - SELinux security policy is enforced.

# permissive - SELinux prints warnings instead of enforcing.

# disabled - No SELinux policy is loaded.

SELINUX=disabled

# SELINUXTYPE= can take one of three values:

# targeted - Targeted processes are protected,

# minimum - Modification of targeted policy. Only selected processes are protected.

# mls - Multi Level Security protection.

SELINUXTYPE=targeted

關閉swap分區

swapoff -a && sysctl -w vm.swappiness=0

注釋後重啟服務器,swap分區就不會再打開

sed -ri '/^[^#]*swap/s@^@#@' /etc/fstab

安裝ntpdate,保證五台服務器時間一致,雲服務器不需要

rpm -ivh //mirrors.wlnmp.com/centos/wlnmp-release-centos.noarch.rpm

yum install ntpdate -y

所有節點同步時間。時間同步配置如下:

ln -sf /usr/share/zoneinfo/Asia/Shanghai /etc/localtime

echo 'Asia/Shanghai' >/etc/timezone

ntpdate time2.aliyun.com

# 查看一下時間

date

# 加入到crontab

crontab -e

*/5 * * * * /usr/sbin/ntpdate time2.aliyun.com

所有節點配置limit:

ulimit -SHn 65535

設置limit永久生效

vim /etc/security/limits.conf

# 末尾添加如下內容

* soft nofile 655360

* hard nofile 131072

* soft nproc 655350

* hard nproc 655350

* soft memlock unlimited

* hard memlock unlimited

取消發送鍵輸入到所有會話

Master01節點免密鑰登錄其他節點,安裝過程中生成配置文件和證書均在Master01上操作,集群管理也在Master01上操作,阿里雲或者AWS上需要單獨一台kubectl服務器。密鑰配置如下:

ssh-keygen -t rsa

# 把文件傳送到五個節點

for i in k8s-master01 k8s-master02 k8s-master03 k8s-node01 k8s-node02;do ssh-copy-id -i .ssh/id_rsa.pub $i;done

下載安裝所有的源碼文件:

cd /root/ ; git clone //github.com/dotbalo/k8s-ha-install.git

無法下載的可以通過本地拉取壓縮再上傳到服務器

yum安裝zip

yum install -y unzip zip

解壓文件

unzip k8s-ha-install.zip

所有節點(發送鍵輸入到所有會話)升級系統並重啟,此處升級沒有升級內核,下節會單獨升級內核:

yum update -y --exclude=kernel* && reboot #CentOS7需要升級,CentOS8可以按需升級系統

推薦centos7,因為CentOS8在2021年停止維護,而centos7到2024年才停止維護

重啟完成之後,查看版本(CentOS Linux release 7.9.2009 (Core))

cat /etc/redhat-release

Kubeadm系統及內核升級

查看內核版本

uname -a

內核3.10版本使用docker會有一些bug,需要升級

CentOS7 需要升級內核至4.18+,本地升級的版本為4.19

在master01節點(取消發送鍵輸入到所有會話)下載內核:

cd /root

wget //193.49.22.109/elrepo/kernel/el7/x86_64/RPMS/kernel-ml-devel-4.19.12-1.el7.elrepo.x86_64.rpm

wget //193.49.22.109/elrepo/kernel/el7/x86_64/RPMS/kernel-ml-4.19.12-1.el7.elrepo.x86_64.rpm

從master01節點傳到其他節點:

for i in k8s-master02 k8s-master03 k8s-node01 k8s-node02;do scp kernel-ml-4.19.12-1.el7.elrepo.x86_64.rpm kernel-ml-devel-4.19.12-1.el7.elrepo.x86_64.rpm $i:/root/ ; done

所有節點(發送鍵輸入到所有會話)安裝內核

cd /root && yum localinstall -y kernel-ml*

所有節點更改內核啟動順序,因為默認是3.10的

grub2-set-default 0 && grub2-mkconfig -o /etc/grub2.cfg

grubby --args="user_namespace.enable=1" --update-kernel="$(grubby --default-kernel)"

檢查默認內核是不是4.19

grubby --default-kernel

所有節點重啟,然後檢查內核是不是4.19

reboot

uname -a

所有節點安裝ipvsadm:

yum install ipvsadm ipset sysstat conntrack libseccomp -y

所有節點配置ipvs模塊,在內核4.19+版本nf_conntrack_ipv4已經改為nf_conntrack, 4.18以下使用nf_conntrack_ipv4即可:

vim /etc/modules-load.d/ipvs.conf

# 加入以下內容

ip_vs

ip_vs_lc

ip_vs_wlc

ip_vs_rr

ip_vs_wrr

ip_vs_lblc

ip_vs_lblcr

ip_vs_dh

ip_vs_sh

ip_vs_fo

ip_vs_nq

ip_vs_sed

ip_vs_ftp

ip_vs_sh

nf_conntrack

ip_tables

ip_set

xt_set

ipt_set

ipt_rpfilter

ipt_REJECT

ipip

加載配置

systemctl enable --now systemd-modules-load.service

開啟一些k8s集群中必須的內核參數,所有節點配置k8s內核:

cat <<EOF > /etc/sysctl.d/k8s.conf

net.ipv4.ip_forward = 1

net.bridge.bridge-nf-call-iptables = 1

net.bridge.bridge-nf-call-ip6tables = 1

fs.may_detach_mounts = 1

vm.overcommit_memory=1

vm.panic_on_oom=0

fs.inotify.max_user_watches=89100

fs.file-max=52706963

fs.nr_open=52706963

net.netfilter.nf_conntrack_max=2310720

net.ipv4.tcp_keepalive_time = 600

net.ipv4.tcp_keepalive_probes = 3

net.ipv4.tcp_keepalive_intvl =15

net.ipv4.tcp_max_tw_buckets = 36000

net.ipv4.tcp_tw_reuse = 1

net.ipv4.tcp_max_orphans = 327680

net.ipv4.tcp_orphan_retries = 3

net.ipv4.tcp_syncookies = 1

net.ipv4.tcp_max_syn_backlog = 16384

net.ipv4.ip_conntrack_max = 65536

net.ipv4.tcp_max_syn_backlog = 16384

net.ipv4.tcp_timestamps = 0

net.core.somaxconn = 16384

EOF

sysctl --system

所有節點配置完內核後,重啟服務器,保證重啟後內核依舊加載

reboot

檢查是否加載

lsmod | grep --color=auto -e ip_vs -e nf_conntrack

Kubeadm基本組件安裝

所有節點安裝Docker-ce 19.03,不需要太新,這是官方已經經過驗證的版本

yum install docker-ce-19.03.* docker-cli-19.03.* -y

由於新版kubelet建議使用systemd,所以可以把docker的CgroupDriver改成systemd

mkdir /etc/docker

cat > /etc/docker/daemon.json <<EOF

{

"exec-opts": ["native.cgroupdriver=systemd"]

}

EOF

所有節點設置開機自啟動Docker:

systemctl daemon-reload && systemctl enable --now docker

查看docker版本(Server Version: 19.03.15,Cgroup Driver: systemd)

docker info

查看k8s最新版本(取消發送鍵輸入到所有會話):

yum list kubeadm.x86_64 --showduplicates | sort -r

最新版本是1.21.2-0,但是推薦小版本大於5才使用,所以安裝1.20版本

所有節點(發送鍵輸入到所有會話)安裝最新版本kubeadm:

yum install kubeadm-1.20* kubelet-1.20* kubectl-1.20* -y

默認配置的pause鏡像使用gcr.io倉庫,國內可能無法訪問,所以這裡配置Kubelet使用阿里雲的pause鏡像:

cat >/etc/sysconfig/kubelet<<EOF

KUBELET_EXTRA_ARGS="--cgroup-driver=systemd --pod-infra-container-image=registry.cn-hangzhou.aliyuncs.com/google_containers/pause-amd64:3.2"

EOF

設置Kubelet開機自啟動:

systemctl daemon-reload

systemctl enable --now kubelet

Kubeadm高可用組件安裝

如果不是高可用集群,haproxy和keepalived無需安裝

公有雲要用公有雲自帶的負載均衡,比如阿里雲的SLB,騰訊雲的ELB,用來替代haproxy和keepalived,因為公有雲大部分都是不支持keepalived的

如果用阿里雲的話,kubectl控制端不能放在master節點,因為阿里雲的slb有迴環的問題,也就是slb代理的服務器不能反向訪問SLB,推薦使用騰訊雲,騰訊雲修復了這個問題。

所有Master節點(node節點取消發送鍵輸入到所有會話)通過yum安裝HAProxy和KeepAlived:

yum install keepalived haproxy -y

所有Master節點配置HAProxy(詳細配置參考HAProxy文檔,所有Master節點的HAProxy配置相同):

vim /etc/haproxy/haproxy.cfg

刪除所有內容

ggdG

添加以下內容,注意首行global是否複製完整

global

maxconn 2000

ulimit-n 16384

log 127.0.0.1 local0 err

stats timeout 30s

defaults

log global

mode http

option httplog

timeout connect 5000

timeout client 50000

timeout server 50000

timeout http-request 15s

timeout http-keep-alive 15s

frontend monitor-in

bind *:33305

mode http

option httplog

monitor-uri /monitor

frontend k8s-master

bind 0.0.0.0:16443

bind 127.0.0.1:16443

mode tcp

option tcplog

tcp-request inspect-delay 5s

default_backend k8s-master

backend k8s-master

mode tcp

option tcplog

option tcp-check

balance roundrobin

default-server inter 10s downinter 5s rise 2 fall 2 slowstart 60s maxconn 250 maxqueue 256 weight 100

server k8s-master01 192.168.232.128:6443 check

server k8s-master02 192.168.232.129:6443 check

server k8s-master03 192.168.232.130:6443 check

所有Master節點配置KeepAlived,配置不一樣,注意每個節點的IP和網卡(interface參數)

查看網卡名稱(ens33)

ip a

如果網卡名稱不是ens33,不要把配置文件中的網卡配置替換

Master01節點的配置:

mkdir /etc/keepalived

vim /etc/keepalived/keepalived.conf

刪除所有內容

ggdG

取消發送鍵輸入到所有會話

添加以下內容,注意首行是否複製完整

! Configuration File for keepalived

global_defs {

router_id LVS_DEVEL

script_user root

enable_script_security

}

vrrp_script chk_apiserver {

script "/etc/keepalived/check_apiserver.sh"

interval 5

weight -5

fall 2

rise 1

}

vrrp_instance VI_1 {

state MASTER

interface ens33

mcast_src_ip 192.168.232.128

virtual_router_id 51

priority 101

advert_int 2

authentication {

auth_type PASS

auth_pass K8SHA_KA_AUTH

}

virtual_ipaddress {

192.168.232.236

}

track_script {

chk_apiserver

}

}

Master02節點的配置:

添加以下內容,注意首行是否複製完整

! Configuration File for keepalived

global_defs {

router_id LVS_DEVEL

script_user root

enable_script_security

}

vrrp_script chk_apiserver {

script "/etc/keepalived/check_apiserver.sh"

interval 5

weight -5

fall 2

rise 1

}

vrrp_instance VI_1 {

state BACKUP

interface ens33

mcast_src_ip 192.168.232.129

virtual_router_id 51

priority 100

advert_int 2

authentication {

auth_type PASS

auth_pass K8SHA_KA_AUTH

}

virtual_ipaddress {

192.168.232.236

}

track_script {

chk_apiserver

}

}

Master03節點的配置:

添加以下內容,注意首行是否複製完整

! Configuration File for keepalived

global_defs {

router_id LVS_DEVEL

script_user root

enable_script_security

}

vrrp_script chk_apiserver {

script "/etc/keepalived/check_apiserver.sh"

interval 5

weight -5

fall 2

rise 1

}

vrrp_instance VI_1 {

state BACKUP

interface ens33

mcast_src_ip 192.168.232.130

virtual_router_id 51

priority 100

advert_int 2

authentication {

auth_type PASS

auth_pass K8SHA_KA_AUTH

}

virtual_ipaddress {

192.168.232.236

}

track_script {

chk_apiserver

}

}

所有master節點(發送鍵輸入到所有會話,取消node節點)配置KeepAlived健康檢查文件:

vim /etc/keepalived/check_apiserver.sh

添加以下內容,注意首行是否複製完整

#!/bin/bash

err=0

for k in $(seq 1 3)

do

check_code=$(pgrep haproxy)

if [[ $check_code == "" ]]; then

err=$(expr $err + 1)

sleep 1

continue

else

err=0

break

fi

done

if [[ $err != "0" ]]; then

echo "systemctl stop keepalived"

/usr/bin/systemctl stop keepalived

exit 1

else

exit 0

fi

我們通過KeepAlived虛擬出來一個VIP,VIP會配置到一個master節點上面,它會通過haproxy暴露的16443的端口反向代理到我們的三個master節點上面,所以我們可以通過VIP的地址加上16443訪問到我們的API server

健康檢查會檢查haproxy的狀態,三次失敗就會將KeepAlived停掉,停掉之後KeepAlived會跳到其他的節點

添加權限

chmod +x /etc/keepalived/check_apiserver.sh

啟動haproxy

systemctl daemon-reload

systemctl enable --now haproxy

查看端口(16443)

netstat -lntp

啟動keepalived

systemctl enable --now keepalived

查看系統日誌(Sending gratuitous ARP on ens33 for 192.168.232.236)

tail -f /var/log/messages

cat /var/log/messages | grep 'ens33' -5

查看ip

ip a

可以看到192.168.232.236綁定到了master01,其他兩個節點是沒有的

測試VIP

ping 192.168.232.236 -c 4

telnet 192.168.232.236 16443

如果ping不通且telnet沒有出現 ] ,則認為VIP不可以,不可在繼續往下執行,需要排查keepalived的問題

- 比如防火牆和selinux,haproxy和keepalived的狀態,監聽端口等

- 所有節點查看防火牆狀態必須為disable和inactive:systemctl status firewalld

- 所有節點查看selinux狀態,必須為disable:getenforce

- master節點查看haproxy和keepalived狀態:systemctl status keepalived haproxy

- master節點查看監聽端口:netstat -lntp

Kubeadm集群初始化

官方初始化文檔://kubernetes.io/docs/setup/production-environment/tools/kubeadm/high-availability/

在生產環境中有些配置需要修改,因為使用默認的配置可能會導致網段衝突,所以我們使用配置文件的形式初始化

發送鍵輸入到所有會話

Master01節點創建 kubeadm-config.yaml 配置文件如下:

vim kubeadm-config.yaml

Master01:(# 注意,如果不是高可用集群,192.168.232.236:16443改為master01的地址,16443改為apiserver的端口,默認是6443,注意更改v1.18.5自己服務器kubeadm的版本:kubeadm version)

以下文件內容,宿主機網段、podSubnet網段、serviceSubnet網段不能重複,具體看前面的高可用Kubernetes集群規劃

apiVersion: kubeadm.k8s.io/v1beta2

bootstrapTokens:

- groups:

- system:bootstrappers:kubeadm:default-node-token

token: 7t2weq.bjbawausm0jaxury

ttl: 24h0m0s

usages:

- signing

- authentication

kind: InitConfiguration

localAPIEndpoint:

advertiseAddress: 192.168.232.128

bindPort: 6443

nodeRegistration:

criSocket: /var/run/dockershim.sock

name: k8s-master01

taints:

- effect: NoSchedule

key: node-role.kubernetes.io/master

---

apiServer:

certSANs:

- 192.168.232.236

timeoutForControlPlane: 4m0s

apiVersion: kubeadm.k8s.io/v1beta2

certificatesDir: /etc/kubernetes/pki

clusterName: kubernetes

controlPlaneEndpoint: 192.168.232.236:16443

controllerManager: {}

dns:

type: CoreDNS

etcd:

local:

dataDir: /var/lib/etcd

imageRepository: registry.cn-hangzhou.aliyuncs.com/google_containers

kind: ClusterConfiguration

kubernetesVersion: v1.20.0

networking:

dnsDomain: cluster.local

podSubnet: 172.168.0.0/12

serviceSubnet: 10.96.0.0/12

scheduler: {}

更新kubeadm文件

kubeadm config migrate --old-config kubeadm-config.yaml --new-config new.yaml

查看kubeadm版本(GitVersion:”v1.20.8″)

kubeadm version

將配置文件中的 kubernetesVersion: v1.20.0 改為一致的 kubernetesVersion: v1.20.8

node節點取消發送鍵輸入到所有會話

將new.yaml文件複製到其他master節點,之後所有Master節點提前下載鏡像,可以節省初始化時間:

kubeadm config images pull --config /root/new.yaml

因為配置了阿里雲鏡像(imageRepository: registry.cn-hangzhou.aliyuncs.com/google_containers),所以下載速度比默認使用的gcr鏡像快,國內訪問不了gcr鏡像

因為配置了token過期時間(ttl: 24h0m0s),所以可能出現今天生成token,明天加入不了集群的問題

同時master節點為我們配置了一個污點(taints),這個污點可以讓我們的mater不部署容器

criSocket就是通過哪一個socket連接我們的docker,dockershim在k8s 1.20版本廢棄,官方不維護,後期可能有人會維護,也可以改成其他cri的runtime

Master01節點(取消發送鍵輸入到所有會話)初始化,初始化以後會在/etc/kubernetes目錄下生成對應的證書和配置文件,之後其他Master節點加入Master01即可:

kubeadm init --config /root/new.yaml --upload-certs

kubeadm 的配置管理是通過 pod 管理的,所有的組件都是通過容器啟動的,通過 /etc/kubernetes/manifests 目錄下面的 yaml 文件啟動,這就是 kubelet 生命周期管理的目錄,在這裏面配置一個 pod 的 yaml 文件,它就會為你管理 pod 的生命周期

進入到該目錄中

cd /etc/kubernetes/manifests

可以看到以下文件

etcd.yaml kube-apiserver.yaml kube-controller-manager.yaml kube-scheduler.yaml

kubeadm 與二進制安裝不一樣的地方在於它的配置管理都在 yaml 文件中,可以編輯文件查看,二進制是一個單獨的server文件,如果更改了配置,千萬不要手動讓它生效,kubelet 會自動幫我們加載配置,重啟容器

如果初始化失敗,重置後再次初始化,命令如下:

kubeadm reset -f ; ipvsadm --clear ; rm -rf ~/.kube

初始化成功以後,會產生Token值,用於其他節點加入時使用,因此要記錄下初始化成功生成的token值(令牌值):

Your Kubernetes control-plane has initialized successfully!

To start using your cluster, you need to run the following as a regular user:

mkdir -p $HOME/.kube

sudo cp -i /etc/kubernetes/admin.conf $HOME/.kube/config

sudo chown $(id -u):$(id -g) $HOME/.kube/config

Alternatively, if you are the root user, you can run:

export KUBECONFIG=/etc/kubernetes/admin.conf

You should now deploy a pod network to the cluster.

Run "kubectl apply -f [podnetwork].yaml" with one of the options listed at:

//kubernetes.io/docs/concepts/cluster-administration/addons/

You can now join any number of the control-plane node running the following command on each as root:

kubeadm join 192.168.232.236:16443 --token 7t2weq.bjbawausm0jaxury \

--discovery-token-ca-cert-hash sha256:3b304187585d91d18d33d171592d4d37ec237d68af4837efebbb5c9ec86072d8 \

--control-plane --certificate-key 7fc2e6005c32476d189b5b4763e2131404df187f7601b01d33370c7485ed2c53

Please note that the certificate-key gives access to cluster sensitive data, keep it secret!

As a safeguard, uploaded-certs will be deleted in two hours; If necessary, you can use

"kubeadm init phase upload-certs --upload-certs" to reload certs afterward.

Then you can join any number of worker nodes by running the following on each as root:

kubeadm join 192.168.232.236:16443 --token 7t2weq.bjbawausm0jaxury \

--discovery-token-ca-cert-hash sha256:3b304187585d91d18d33d171592d4d37ec237d68af4837efebbb5c9ec86072d8

Master01節點配置環境變量,用於訪問Kubernetes集群:

cat <<EOF >> /root/.bashrc

export KUBECONFIG=/etc/kubernetes/admin.conf

EOF

source /root/.bashrc

管理集群的命令 kubectl 只需要在一個節點上面有就可以,這個節點可以是 k8s 節點,也可以不是,它就是通過 admin.conf 文件和 k8s 通訊的,文件中定義了一個變量 KUBECONFIG,指定了文件的地址,然後我們就可以操作我們的集群了

查看節點狀態:

kubectl get nodes

可以看到它添加了一個規則 control-plane

NAME STATUS ROLES AGE VERSION

k8s-master01 NotReady control-plane,master 3m54s v1.20.8

查看server:

kubectl get svc

可以看到以下的server

NAME TYPE CLUSTER-IP EXTERNAL-IP PORT(S) AGE

kubernetes ClusterIP 10.96.0.1 <none> 443/TCP 5m32s

採用初始化安裝方式,所有的系統組件均以容器的方式運行並且在kube-system命名空間內,生產環境建議創建一個namespaces

此時可以查看Pod狀態:

kubectl get pods -n kube-system -o wide

可以看到以下的pod

NAME READY STATUS RESTARTS AGE IP NODE NOMINATED NODE READINESS GATES

coredns-54d67798b7-lrvm8 0/1 Pending 0 6m40s <none> <none> <none> <none>

coredns-54d67798b7-tkfrx 0/1 Pending 0 6m40s <none> <none> <none> <none>

etcd-k8s-master01 1/1 Running 0 6m34s 192.168.232.128 k8s-master01 <none> <none>

kube-apiserver-k8s-master01 1/1 Running 0 6m34s 192.168.232.128 k8s-master01 <none> <none>

kube-controller-manager-k8s-master01 1/1 Running 0 6m34s 192.168.232.128 k8s-master01 <none> <none>

kube-proxy-4gwlb 1/1 Running 0 6m40s 192.168.232.128 k8s-master01 <none> <none>

kube-scheduler-k8s-master01 1/1 Running 0 6m34s 192.168.232.128 k8s-master01 <none> <none>

高可用Master及Token過期處理

注意:以下步驟是上述init命令產生的Token過期了才需要執行以下步驟,如果沒有過期不需要執行

Token過期後生成新的token:

kubeadm token create --print-join-command

Master需要生成–certificate-key

kubeadm init phase upload-certs --upload-certs

Token沒有過期直接執行Join

初始化master02加入集群

kubeadm join 192.168.232.236:16443 --token 7t2weq.bjbawausm0jaxury \

--discovery-token-ca-cert-hash sha256:3b304187585d91d18d33d171592d4d37ec237d68af4837efebbb5c9ec86072d8 \

--control-plane --certificate-key 7fc2e6005c32476d189b5b4763e2131404df187f7601b01d33370c7485ed2c53

在master01查看其他節點

kubectl get node

可以看到master02節點

NAME STATUS ROLES AGE VERSION

k8s-master01 NotReady control-plane,master 25m v1.20.8

k8s-master02 NotReady control-plane,master 91s v1.20.8

嘗試重新生成token

kubeadm token create --print-join-command

kubeadm init phase upload-certs --upload-certs

替換參數,初始化master03加入集群

kubeadm join 192.168.232.236:16443 --token rff9me.bhgzm7d3j2uoq5fv --discovery-token-ca-cert-hash sha256:3b304187585d91d18d33d171592d4d37ec237d68af4837efebbb5c9ec86072d8 \

--control-plane --certificate-key d3fb9602f75f4f879d4eea083129bd110734824ef8721c956be95ae481022992

可以在master01查看新生成的token

kubectl get secret -n kube-system

這就是新生成的token

NAME TYPE DATA AGE

bootstrap-token-rff9me bootstrap.kubernetes.io/token 6 3m31s

查看token內容:

kubectl get secret -n kube-system bootstrap-token-rff9me -oyaml

可以看到過期時間(這是通過base64加密的):

expiration: MjAyMS0wNy0wOFQxNzo0MjoyMiswODowMA==

解密一下:

echo "MjAyMS0wNy0wOFQxNzo0MjoyMiswODowMA==" | base64 -d

可以看到解密後的時間

2021-07-08T22:42:22+08:00

Kubeadm Node及Calico節點配置

Kubeadm Node

Node節點上主要部署公司的一些業務應用,生產環境中不建議Master節點部署系統組件之外的其他Pod,測試環境可以允許Master節點部署Pod以節省系統資源。

初始化node01,node02加入集群(與master相比,不需要control-plane)

kubeadm join 192.168.232.236:16443 --token 7t2weq.bjbawausm0jaxury \

--discovery-token-ca-cert-hash sha256:3b304187585d91d18d33d171592d4d37ec237d68af4837efebbb5c9ec86072d8

所有節點初始化完成後,查看集群狀態

kubectl get node

可以看到所有節點

NAME STATUS ROLES AGE VERSION

k8s-master01 NotReady control-plane,master 39m v1.20.8

k8s-master02 NotReady control-plane,master 16m v1.20.8

k8s-master03 NotReady control-plane,master 9m38s v1.20.8

k8s-node01 NotReady <none> 22s v1.20.8

k8s-node02 NotReady <none> 11s v1.20.8

Calico節點配置

以下步驟只在master01執行

cd /root/k8s-ha-install && git checkout manual-installation-v1.20.x && cd calico/

如果是本地下載上傳的話需要現在本地切換分支再上傳

unzip k8s-ha-install.zip

cd k8s-ha-install/calico/

修改calico-etcd.yaml的以下位置:

修改etcd的節點

sed -i 's#etcd_endpoints: "//<ETCD_IP>:<ETCD_PORT>"#etcd_endpoints: "//192.168.232.128:2379,//192.168.232.129:2379,//192.168.232.130:2379"#g' calico-etcd.yaml

使用默認配置

ETCD_CA=`cat /etc/kubernetes/pki/etcd/ca.crt | base64 | tr -d '\n'`

ETCD_CERT=`cat /etc/kubernetes/pki/etcd/server.crt | base64 | tr -d '\n'`

ETCD_KEY=`cat /etc/kubernetes/pki/etcd/server.key | base64 | tr -d '\n'`

sed -i "s@# etcd-key: null@etcd-key: ${ETCD_KEY}@g; s@# etcd-cert: null@etcd-cert: ${ETCD_CERT}@g; s@# etcd-ca: null@etcd-ca: ${ETCD_CA}@g" calico-etcd.yaml

把 etcd_key 放到 secret 裏面,secret 會掛載到 calico 容器的 pod 裏面,掛載的名稱就是 ETCD_CA,這樣 calico 就能找到證書,就可以連接到 etcd,就可以把 pod 信息存儲到 etcd 裏面

sed -i 's#etcd_ca: ""#etcd_ca: "/calico-secrets/etcd-ca"#g; s#etcd_cert: ""#etcd_cert: "/calico-secrets/etcd-cert"#g; s#etcd_key: "" #etcd_key: "/calico-secrets/etcd-key" #g' calico-etcd.yaml

修改 pod 網段

POD_SUBNET=`cat /etc/kubernetes/manifests/kube-controller-manager.yaml | grep cluster-cidr= | awk -F= '{print $NF}'`

注意下面的這個步驟是把calico-etcd.yaml文件裏面的CALICO_IPV4POOL_CIDR下的網段改成自己的Pod網段,也就是把192.168.x.x/16改成自己的集群網段,並打開注釋,所以更改的時候請確保這個步驟的這個網段沒有被統一替換掉,如果被替換掉了,還請改回來:

sed -i 's@# - name: CALICO_IPV4POOL_CIDR@- name: CALICO_IPV4POOL_CIDR@g; s@# value: "192.168.0.0/16"@ value: '"${POD_SUBNET}"'@g' calico-etcd.yaml

檢查文件:

vim calico-etcd.yaml

可以看到 etcd-key 已經導入進來,它就是把證書 /etc/kubernetes/pki/etcd/ca.crt 讀取出來,再經過 base64 加密,再填到這個位置

安裝 calico

kubectl apply -f calico-etcd.yaml

查看容器狀態

kubectl get po -n kube-system

成功運行

NAME READY STATUS RESTARTS AGE

calico-kube-controllers-5f6d4b864b-f2ssh 1/1 Running 0 2m54s

calico-node-78wg7 1/1 Running 0 2m54s

calico-node-8hxxj 1/1 Running 0 2m54s

calico-node-8t4c9 1/1 Running 0 2m54s

calico-node-fgwdv 1/1 Running 0 2m54s

calico-node-jzh8w 1/1 Running 0 2m54s

目前用的是阿里雲的鏡像,生產環境需要推薦使用自己的鏡像倉庫,這樣速度更快

Dashboard&Metrics Server安裝

Metrics Server

在新版的Kubernetes中系統資源的採集均使用Metrics-server,可以通過Metrics採集節點和Pod的內存、磁盤、CPU和網絡的使用率。

github 地址://github.com/kubernetes-sigs/metrics-server

查看yaml文件配置

cd metrics-server-0.4.x-kubeadm/

vim comp.yaml

添加了證書,不然可能導致獲取不到度量指標

- --requestheader-client-ca-file=/etc/kubernetes/pki/front-proxy-ca.crt # change to front-proxy-ca.crt for kubeadm

鏡像地址也修改為阿里雲

image: registry.cn-beijing.aliyuncs.com/dotbalo/metrics-server:v0.4.1

將Master01節點的front-proxy-ca.crt複製到所有Node節點

scp /etc/kubernetes/pki/front-proxy-ca.crt k8s-node01:/etc/kubernetes/pki/front-proxy-ca.crt

scp /etc/kubernetes/pki/front-proxy-ca.crt k8s-node02:/etc/kubernetes/pki/front-proxy-ca.crt

安裝metrics server

cd /root/k8s-ha-install/metrics-server-0.4.x-kubeadm/

kubectl create -f comp.yaml

查看狀態

kubectl top node

顯示CPU狀態,內存使用量

NAME CPU(cores) CPU% MEMORY(bytes) MEMORY%

k8s-master01 204m 10% 1114Mi 59%

k8s-master02 128m 6% 1133Mi 60%

k8s-master03 113m 5% 1056Mi 56%

k8s-node01 54m 2% 809Mi 43%

k8s-node02 71m 3% 834Mi 44%

Dashboard部署

Dashboard用於展示集群中的各類資源,同時也可以通過Dashboard實時查看Pod的日誌和在容器中執行一些命令等。

github 地址://github.com/kubernetes/dashboard

安裝指定版本dashboard

查看yaml文件配置

cd /root/k8s-ha-install/dashboard/

grep "image" dashboard.yaml

可以看到只修改了鏡像地址

image: registry.cn-beijing.aliyuncs.com/dotbalo/dashboard:v2.0.4

imagePullPolicy: Always

image: registry.cn-beijing.aliyuncs.com/dotbalo/metrics-scraper:v1.0.4

注意:所有的鏡像包括caclico, coredns, etcd等等都要放到自己公司內部的鏡像倉庫,這樣發佈、更新、故障恢復的速度更快

安裝

kubectl create -f .

安裝最新版

如果需要訪問最新版本可以訪問官方github獲取連接,但是沒必要安裝最新

kubectl apply -f //raw.githubusercontent.com/kubernetes/dashboard/v2.0.3/aio/deploy/recommended.yaml

創建管理員用戶vim admin.yaml

apiVersion: v1

kind: ServiceAccount

metadata:

name: admin-user

namespace: kube-system

---

apiVersion: rbac.authorization.k8s.io/v1

kind: ClusterRoleBinding

metadata:

name: admin-user

annotations:

rbac.authorization.kubernetes.io/autoupdate: "true"

roleRef:

apiGroup: rbac.authorization.k8s.io

kind: ClusterRole

name: cluster-admin

subjects:

- kind: ServiceAccount

name: admin-user

namespace: kube-system

應用

kubectl apply -f admin.yaml -n kube-system

登錄dashboard

在谷歌瀏覽器(Chrome)啟動文件中加入啟動參數,用於解決無法訪問Dashboard的問題

--test-type --ignore-certificate-errors

右鍵–屬性–快捷方式–目標

"C:\Program Files\Google\Chrome\Application\chrome.exe" --test-type --ignore-certificate-errors

更改dashboard的svc為NodePort:

kubectl edit svc kubernetes-dashboard -n kubernetes-dashboard

將ClusterIP更改為NodePort(如果已經為NodePort忽略此步驟)

查看端口號:

kubectl get svc kubernetes-dashboard -n kubernetes-dashboard

端口號為10.99.156.65

NAME TYPE CLUSTER-IP EXTERNAL-IP PORT(S) AGE

kubernetes-dashboard NodePort 10.99.156.65 <none> 443:32272/TCP 9m58s

查看容器是否啟動完成

kubectl get po -A

根據自己的實例端口號,通過任意安裝了kube-proxy的宿主機或者VIP的IP+端口即可訪問到dashboard:

訪問Dashboard://192.168.232.236:32272(請更改32272為自己的端口),選擇登錄方式為令牌(即token方式)

也可以通過宿主機的ip訪問://192.168.232.128:32272

查看端口佔用

netstat -lntp

佔用情況

Active Internet connections (only servers)

Proto Recv-Q Send-Q Local Address Foreign Address State PID/Program name

tcp 0 0 0.0.0.0:32272 0.0.0.0:* LISTEN 31552/kube-proxy

可以看到 NodePort 所做的事情就是在宿主機上啟動一個端口號 32272,這個端口號會對應到 dashboard,每一台服務器都會啟動這個端口,都可以訪問到 dashboard

//192.168.232.129:32272

//192.168.232.130:32272

//192.168.232.131:32272

//192.168.232.132:32272

查看token值:

kubectl -n kube-system describe secret $(kubectl -n kube-system get secret | grep admin-user | awk '{print $1}')

得到token值:

token: eyJhbGciOiJSUzI1NiIsImtpZCI6IkxReUpVOGk4b0FrUUlLVDgyb1hTb0U1Uzg4cHZYRzBMRXJqOERHRDJMQ0EifQ.eyJpc3MiOiJrdWJlcm5ldGVzL3NlcnZpY2VhY2NvdW50Iiwia3ViZXJuZXRlcy5pby9zZXJ2aWNlYWNjb3VudC9uYW1lc3BhY2UiOiJrdWJlLXN5c3RlbSIsImt1YmVybmV0ZXMuaW8vc2VydmljZWFjY291bnQvc2VjcmV0Lm5hbWUiOiJhZG1pbi11c2VyLXRva2VuLXJ2bW1oIiwia3ViZXJuZXRlcy5pby9zZXJ2aWNlYWNjb3VudC9zZXJ2aWNlLWFjY291bnQubmFtZSI6ImFkbWluLXVzZXIiLCJrdWJlcm5ldGVzLmlvL3NlcnZpY2VhY2NvdW50L3NlcnZpY2UtYWNjb3VudC51aWQiOiIxMDkwNTc5MS1mMmJmLTRlMmQtYjJiNy1hYTRlNjU5YTM1MjQiLCJzdWIiOiJzeXN0ZW06c2VydmljZWFjY291bnQ6a3ViZS1zeXN0ZW06YWRtaW4tdXNlciJ9.UEayfCEyeAx-wrguqqyZIKTr1O9OzFyksowng6J54BhdonBhF3JEcbJlykjRfP4DZzpniorWdwE6AhuE-VQ8xiyKcMEl8mnnovHM3T65v1DsD3KSdfFnbdFXLyEnA7zeS7-7oh7-fQkEHcPvEWJGO7OJq3aVVxxVqgvecuxkC0v43Bp3yVlZZ94bmRpy3VeEtAJ1KYgDH33oSOzBqRJ5GOWqCicepQFlwsrERu8slwa1yazu7upcR7mn2H-bXZxZY09HPG3gM0xypfULhdV8xd7ZI1wovm29na_PjcPB8w3b3tMbqF8ee5BKQdZGORZWYdAZhActT33rYqhZs_1ieg

將token值輸入到令牌後,單擊登錄即可訪問Dashboard

切換 namespace 到 kube-system

一些必須的配置更改

將Kube-proxy改為ipvs模式,因為在初始化集群的時候注釋了ipvs配置,所以需要自行修改一下:

在master01節點執行

kubectl edit cm kube-proxy -n kube-system

搜索定位到mode

/mode 回車

修改為 ipvs

mode: 「ipvs」

保存退出:shift + z + z

更新 Kube-Proxy 的 Pod:

kubectl patch daemonset kube-proxy -p "{\"spec\":{\"template\":{\"metadata\":{\"annotations\":{\"date\":\"`date +'%s'`\"}}}}}" -n kube-system

查看 pod 滾動更新

kubectl get po -n kube-system -owide

可以看到新起的是在 master03

NAME READY STATUS RESTARTS AGE IP NODE NOMINATED NODE READINESS GATES

kube-proxy-47pww 1/1 Running 0 2m33s 192.168.232.129 k8s-master02 <none> <none>

kube-proxy-4mlnm 1/1 Running 0 2m21s 192.168.232.128 k8s-master01 <none> <none>

kube-proxy-6h8mx 1/1 Running 0 2m8s 192.168.232.132 k8s-node02 <none> <none>

kube-proxy-6p7hg 1/1 Running 0 2m12s 192.168.232.131 k8s-node01 <none> <none>

kube-proxy-fzgws 1/1 Running 0 118s 192.168.232.130 k8s-master03 <none> <none>

在 master03 驗證 Kube-Proxy 模式,接着可以在所有服務器驗證一下

curl 127.0.0.1:10249/proxyMode

注意事項

kubeadm安裝的集群,證書有效期默認是一年。master節點的kube-apiserver、kube-scheduler、kube-controller-manager、etcd都是以容器運行的。可以通過kubectl get po -n kube-system查看。

啟動和二進制的區別:

kubelet的配置文件在/etc/sysconfig/kubelet和/var/lib/kubelet/config.yaml,修改後需要重啟kubelet進程

其他組件的配置文件在/etc/kubernetes/manifests目錄下,比如kube-apiserver.yaml,該yaml文件更改後,kubelet會自動刷新配置,也就是會重啟pod。不能再次創建該文件

kube-proxy的配置在kube-system命名空間下的configmap中,可以通過

kubectl edit cm kube-proxy -n kube-system

進行更改,更改完成後,可以通過patch重啟kube-proxy

kubectl patch daemonset kube-proxy -p "{\"spec\":{\"template\":{\"metadata\":{\"annotations\":{\"date\":\"`date +'%s'`\"}}}}}" -n kube-system

Kubeadm安裝後,master節點默認不允許部署pod,會佔用資源,在學習過程中可以通過以下方式打開:

查看Taints:

kubectl describe node -l node-role.kubernetes.io/master= | grep Taints

可以看到三個污點

Taints: node-role.kubernetes.io/master:NoSchedule

Taints: node-role.kubernetes.io/master:NoSchedule

Taints: node-role.kubernetes.io/master:NoSchedule

刪除Taint:

kubectl taint node -l node-role.kubernetes.io/master node-role.kubernetes.io/master:NoSchedule-

查看Taints:

kubectl describe node -l node-role.kubernetes.io/master= | grep Taints

可以看到三個污點

Taints: <none>

Taints: <none>

Taints: <none>

課程鏈接(私信我領取專屬福利)

本作品採用知識共享署名-非商業性使用-相同方式共享 4.0 國際許可協議進行許可。

歡迎轉載、使用、重新發佈,但務必保留文章署名 鄭子銘 (包含鏈接: //www.cnblogs.com/MingsonZheng/ ),不得用於商業目的,基於本文修改後的作品務必以相同的許可發佈。