大数据 | 分布式文件系统 HDFS

HDFS全称Hadoop Distributed File System,看名字就知道是Hadoop生态的一个组件,它是一个分布式文件系统。

它的出现解决了独立机器存储大数据集的压力,它将数据集进行切分,存储在若干台计算机上。

HDFS 的特点与应用场景

适合存储大文件

HDFS 支持 GB 级别甚至 TB 级别的文件,它会把大文件切分成若干个块存储在不同的节点上,在进行大文件读写时采用并行的方式提高数据的吞吐量。

容错性高

HDFS有多副本机制,它会自动保存副本到不同的节点。即使有一台节点宕机了也不会丢失数据。

适用于流式的数据访问

HDFS 适用于批量数据的处理,不适合交互式处理。它设计的目标是通过流式的数据访问保证高吞吐量,不适合对低延迟用户响应的应用。

适用于读多写少场景

HDFS 中的文件支持一次写入、多次读取,写入操作是以追加的方式(append)添加在文件末尾,不支持对文件的任意位置进行修改。

HDFS的相关概念

数据块(Block)

和磁盘的数据块概念相似,磁盘中的块是数据读写的最小单位,而HDFS中文件被切分成多个块,作为独立的存储单元,但是比磁盘的块大得多,默认为128MB,且小于一个块大小的文件不会占据整个块的空间。

需要说明的一点是,数据块不能设置太小,否则在查找的过程中会造成寻址时间长,导致效率慢;另一方面,数据块太小会造成很多小文件,进而造成元数据也更多,占用内存就更多。

NameNode和DataNode

HDFS中由NameNode和DataNode组成Master-Slave模式(主从模式)运行,NameNode负责管理文件系统的命名空间和文件元数据,记录了每个文件中各个块所在的数据节点信息,而DataNode则是HDFS中的工作节点,负责存储数据和读写操作。简单理解就是NameNode是主管,DataNode是负责干活的工人。

Secondary NameNode

若NameNode故障,文件系统上的文件将会丢失,因此对NameNode实现容错很重要,Hadoop中提供了两种容错机制,一种是备份那些组成文件系统元数据持久状态的文件;另一种就是用Secondary NameNode.

需要注意的是,Secondary NameNode运行在独立的计算机上,它只是一个辅助而不是一个备用,它不能被用于NameNode。它用于定期合并编辑日志和命名空间镜像,防止编辑日志过大,在NameNode发生故障时启用。

块缓存

DataNode进行读写操作,一般是从磁盘读取,但对于读取频繁的文件,可以被缓存在DataNode的内存中,以提高读操作的性能。

HDFS 架构

Namenode管理元数据;Datanode存储Block;Block有多个副本存在不同的节点;节点可以放在不同的机架(Rack);客户端通过与Namenode与Datanode交互读取数据(具体的读写流程后面讲)

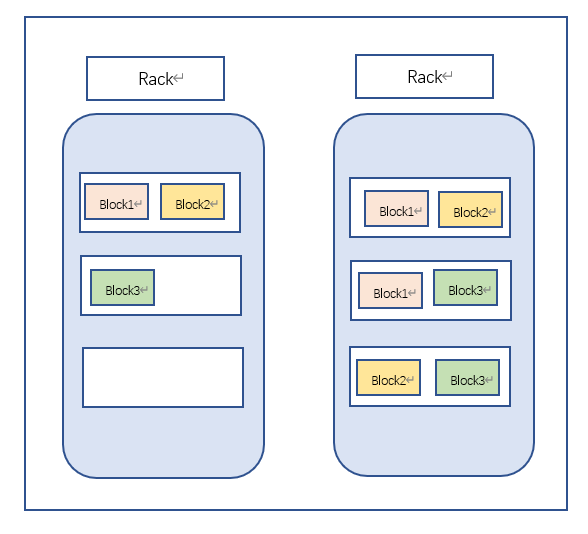

机架感知和副本机制

通常,大型Hadoop集群会分布在很多机架上。

一般为了提高效率,希望不同节点之间的通信尽量发生在同一个机架之内,而不是跨机架。

另外为了提高容错能力,尽可能把数据块的副本放到多个机架上。

机架感知并不是自动感知的,而是需要管理者告知集群实现的。

以一个三副本为例,HDFS机架感知和副本机制大概如图所示

读写流程

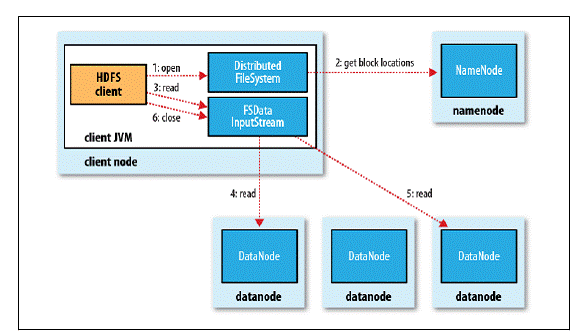

读操作

简要流程:

客户端向NameNode发起读数据请求;

NameNode响应请求并告诉客户端要读的文件的数据块位置;

客户端就近到对应DataNode取数,当数据读取到达末端,关闭与这个DataNode的连接,并查找下一个数据块,直到文件数据全部读完;

最后关闭输出流。

详细流程:

-

客户端通过调用 FileSystem 对象的 open() 方法来打开希望读取的文件,对于 HDFS 来说,这个对象是分布式文件系统的一个实例;

-

DistributedFileSystem 通过RPC 调用 NameNode 以确定文件起始块的位置,由于存在多个副本,因此Namenode会返回同一个Block的多个文件的位置,然后根据集群拓扑结构排序,就近取;

-

前两步会返回一个 FSDataInputStream 对象,该对象会被封装成 DFSInputStream 对象,DFSInputStream 可以方便的管理 datanode 和 namenode 数据流,客户端对这个输入流调用 read() 方法;

-

存储着文件起始块的 DataNode 地址的 DFSInputStream 随即连接距离最近的 DataNode,通过对数据流反复调用 read() 方法,可以将数据从 DataNode 传输到客户端;

-

到达块的末端时,DFSInputStream 会关闭与该 DataNode 的连接,然后寻找下一个块的最佳 DataNode,这些操作对客户端来说是透明的,从客户端的角度来看只是读一个持续不断的流;

-

一旦客户端完成读取,就对 FSDataInputStream 调用 close() 方法关闭文件读取。

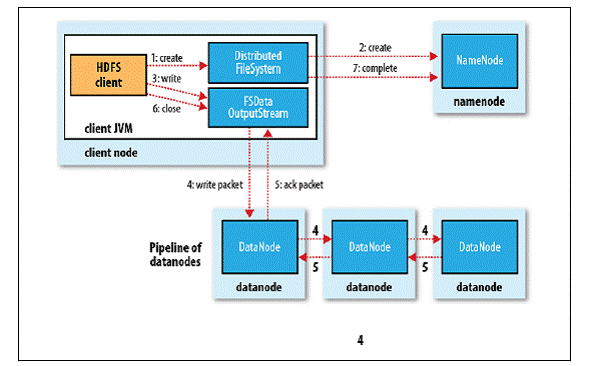

写操作

简单流程:

客户端发起写数据请求;

NameNode响应请求,然后做一些检查,比如查看文件是否存在,达标则创建文件;

客户端将文件切分成若干个块,然后上传,先把第一个块传到Datanode1,然后Datanode1再传给Datanode2,以此类推,传完为止;

成功后DataNode会返回一个确认队列给客户端,客户端进行效验,然后客户端上传下一个数据块到DataNode,直到所有数据块写入完成;

当所有数据块全部写入成功后,客户端会向NameNode发送一个反馈并关闭数据流。

详细流程:

-

客户端通过调用 DistributedFileSystem 的 create() 方法创建新文件;

-

DistributedFileSystem 通过 RPC 调用 NameNode 去创建一个没有 Blocks 关联的新文件,创建前 NameNode 会做各种校验,比如文件是否存在、客户端有无权限去创建等。如果校验通过,NameNode 会为创建新文件记录一条记录,否则就会抛出 IO 异常;

-

前两步结束后会返回 FSDataOutputStream 的对象,和读文件的时候相似,FSDataOutputStream 被封装成 DFSOutputStream,DFSOutputStream 可以协调 NameNode 和 Datanode。客户端开始写数据到 DFSOutputStream,DFSOutputStream 会把数据切成一个个小的数据包,并写入内部队列称为“数据队列”(Data Queue);

-

DataStreamer 会去处理接受 Data Queue,它先问询 NameNode 这个新的 Block 最适合存储在哪几个 DataNode 里,比如重复数是 3,那么就找到 3 个最适合的 DataNode,把他们排成一个 pipeline。DataStreamer 把 Packet 按队列输出到管道的第一个 Datanode 中,第一个 DataNode 又把 Packet 输出到第二个 DataNode 中,以此类推;

-

DFSOutputStream 还有一个队列叫 Ack Quene,也是由 Packet 组成,等待 DataNode 的收到响应,当 Pipeline 中的所有 DataNode 都表示已经收到的时候,这时 Akc Quene 才会把对应的 Packet 包移除掉;

-

客户端完成写数据后调用 close() 方法关闭写入流;

-

DataStreamer 把剩余的包都刷到 Pipeline 里然后等待 Ack 信息,收到最后一个 Ack 后,通知 NameNode 把文件标示为已完成。

总结

本文简单讲了 HDFS 的特点与应用场景、相关概念、架构、副本机制和机架感知以及读写流程。如果觉得有帮到你或者有所收获,麻烦动动小手点个赞或随手转发。

微信扫码关注不迷路,第一时间获取文章哦