佐治亚理工学院发文:不要迷信可解释性,小心被误导

编译 | 王晔

可解释性对人工智能发展来说至关重要,但在可解释系统的可信度方面,理解其可能带来的负面效应亦同等重要。

近日,佐治亚理工学院研究团队发表最新研究,重点讨论了可解释人工智能系统(XAI)中一种重要却未被阐明的负面效应。

论文地址://arxiv.org/pdf/2109.12480.pdf

在这篇论文中,作者提出“可解释性陷阱(EPs)”的概念,指出即使设计者最初没有操控用户的意图,模型的可解释性也可能带来意料之外的负面影响,它不同于具有刻意欺骗性质的黑暗模式(DPs),但又与之相关。本文通过一项案例研究具体阐述了Eps概念,并证实解释的负面影响不可避免,最后作者进一步从研究、设计和组织三个层面提出了具体的应对策略。

发展可解释、可信的新一代人工智能越来越重要,因为人工智能已被广泛应用于医疗保健、金融、刑事司法等高风险决策领域。为了提高人工智能的安全性,我们需要打开AI内部运作的黑匣子,为用户提供可理解的解释。

目前关于可解释AI(XAI)的研究已经取得了令人称赞的进展,但最新研究发现,这些解释所带来的的影响不一定是积极的,也可能在下游任务中产生消极影响。例如设模型计者故意制造不合理的解释,让人们对人工智能系统产生信任,从而隐瞒其可能带来的风险。更重要的是,尽管模型设计的最初意图是好的,这种负面影响似乎也不可避免。

在这种情况下,我们要如何区分有意和无意的负面解释?又如何将有意的负面效应概念化?

论文地址://arxiv.org/pdf/2109.12480.pdf

在这篇论文中,作者提出“可解释性陷阱(EPs)”的概念,指出即使设计者最初没有操控用户的意图,模型的可解释性也可能带来意料之外的负面影响,它不同于具有刻意欺骗性质的黑暗模式(DPs),但又与之相关。本文通过一项案例研究具体阐述了Eps概念,并证实解释的负面影响不可避免,最后作者进一步从研究、设计和组织三个层面提出了具体的应对策略。

发展可解释、可信的新一代人工智能越来越重要,因为人工智能已被广泛应用于医疗保健、金融、刑事司法等高风险决策领域。为了提高人工智能的安全性,我们需要打开AI内部运作的黑匣子,为用户提供可理解的解释。

目前关于可解释AI(XAI)的研究已经取得了令人称赞的进展,但最新研究发现,这些解释所带来的的影响不一定是积极的,也可能在下游任务中产生消极影响。例如设模型计者故意制造不合理的解释,让人们对人工智能系统产生信任,从而隐瞒其可能带来的风险。更重要的是,尽管模型设计的最初意图是好的,这种负面影响似乎也不可避免。

在这种情况下,我们要如何区分有意和无意的负面解释?又如何将有意的负面效应概念化?

作者引入“可解释性陷阱(Explainability pitfalls ,EPs)”的概念,指出人工智能解释可能会误导用户在不知情、无防备的情况下做出符合第三方利益的决策。用户对人工智能的信任,能力的高估,以及对某些解释的过度依赖,是他们在无意识中被“可解释性”操控的主要原因。

EPs和DPs之间的最大区别在于“意图”不同——DPs存在故意欺骗的性质,不考虑到用户的利益。但EPs通过故意设置“陷阱(pitfalls)”也可以变成黑暗模式。

EPs的概念并不是纯粹的理论推导后的结果,而是在大量实际工作和经验的基础上提出的。这项工作展示了尽管没有欺骗的意图,但在人工智能解释的确会出现意料之外的负面影响.

本文不是一篇关于EPs的全面论述,而是在现有概念和实践上迈出了基础性的一步。作者表示,提出可解释性陷阱的概念,是为了让人们认识到未曾发掘的知识盲点(围绕人工智能解释的负面影响),并以此扩大XAI系统的设计空间。

在这项研究中,作者调查了两个不同的群体——有人工智能背景和没有人工智能背景的人,他们如何看待不同类型的人工智能解释。以下是用户对AI生成的三种解释的看法:

在这项研究中,参与者观看了三个智能体在连续决策环境中的导航视频,并提供了定性和定量的感知信息——在一个满是滚动的巨石和流动的熔岩的环境中,为被困的探险者取回必须供应的食物。

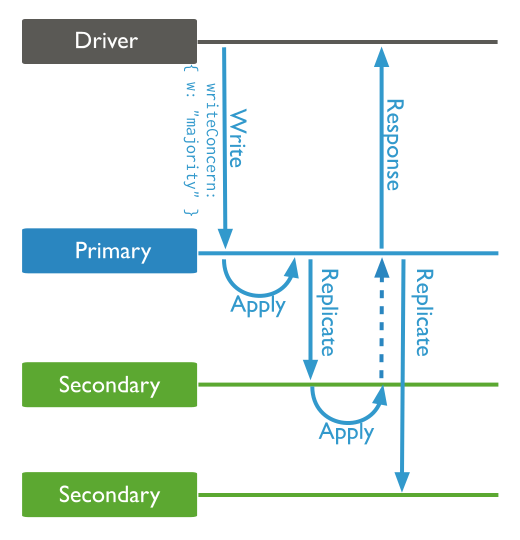

智能体通过简单地输出当前状态的数字Q值执行 “思考”过程(如图1)。Q值代表智能体对每个行动的信任程度(不包含 “为什么”可信),参与者事前没有被告知这些Q值的意义,所以他们不知道哪些数值对应哪些行动。

实验发现,两类参与者都对数字盲目信任,但信任的程度和原因不同。作者采用”认知启发”的概念,试图理解背后的原因。他们发现,

对于有人工智能背景的参与者来说,仅仅是出现的数字就能引发启发式思考。他们不完全理解智能体决策背后的逻辑,但也会将数学表示法与逻辑算法的思维过程联系起来。有意思的是,他们还把最聪明的AI投给了“行为最奇怪”的智能体,这说明,他们不仅过度重视数字结果,而且将“含义不明”的数字视为潜在的可操作性。这里的”可操作性”指的是在判断或预测未来行为方面,人们可以用这些信息做什么。

那么,智能体在实际场景中的可操作性到底如何?正如之前所强调的,Q值不能表明决策背后的 “原因”。除了评估现有行动的质量,这些数字并没有太多可操作性。也就是说,参与者对智能体产生了过度信任和错位评估。

对于没有人工智能背景的参与者来说,即使无法理解复杂的数字也会引发启发式推理,在他们看来,智能体就一定是智能的,这些数字代表了智能体“神秘而不可理解”的独特语言。需要说明的是,这种推理方式与之前有人工智能背景的人的推理过程不同,他们假设了未来的可操作性(尽管目前缺乏可理解性)。

如我们所看到的,没有标记的、无法理解的数字反而增加了两类群体对智能体的信任和评估。这项案例研究表明,即使没有欺骗的意图,EPs也会出现未曾预料到的结果,并误导参与者对数字生成过度依赖。

需要强调的是,本次案例假设Q值的“本意”是好的,如果这些数字被操纵了,一些人利用这些隐患恶意设计黑暗模式,鉴于案例中用户对数字的启发式信任,这将会误导更多人对系统产生过度信任和不正确认知。

总结来看,可解释性陷阱(EPs)有两个特性,一是它仅是存在,但并不一定会对下游产生危害;二是现有知识不能预测给定的一个人工智能解释何时、如何以及为何会引发意料之外的负面下游效应。

基于以上两点,作者认为虽然我们不太可能完全消除解释的负面效应,但需要意识到“陷阱”的存在,了解它们何时容易出现,又是如何运作的,并制定相应的措施,做到防微杜渐。文中作者从研究、设计和组织三个相互关联的层面提出了几点策略:

在研究层面,开展更多以人为本的情境和经验性研究,以获得不同解释对不同利益相关者在多维度下的精细理解。这是因为当下游效应(如用户对人工智能解释的看法)表现出来时,陷阱就会表显露并被识别。如上述案例,具有不同人工智能背景的用户引发了同样的陷阱(即,对数字过度信任),但却有不同的启发模式。

其实,基于这则案例,我们还可以从用户知识背景和理解分歧两个维度进一步探讨:用户的组合特征(如教育背景和专业背景)如何影响 EPs的易感性?不同的启发式方法如何发现不利影响?不同的用户如何适应意料之外的解释?在这些探索中,具备陷阱意识可以帮助我们提高洞察力,发现人们对人工智能解释的反应是如何与设计者的意图相背离的。

在设计层面上,一个有效的策略是强化用户在解释过程中的反思(而不是一味地接受)。最近以人为本的XAI工作也主张将通过反思来促进信任的方法概念化。Langer等人指出,如果我们不对解释进行有意识的和慎重的思考,就会增加掉进“陷阱”的可能。为了引发人们的注意,Langer等人建议设计 “努力的反应 “或 “有思想的反应”,它可以采用缝合设计的视角来帮助提高注意力。有缝设计是对计算系统中 “无缝 “概念的补充,其概念根源在于普适计算。接缝的概念与XAI非常吻合,这是由于:(a)人工智能系统被部署seamful spaces空间中;(b)该方法可以被看作是对“seamless”的黑暗模式人工智能决策的回应,具有“zero friction”或理解力。

就形式和功能而言,seams战略性地揭示了不同部分之间的复杂性和连接机制,同时隐藏了分散注意力的元素。这种 “战略性揭示和隐藏 (strategic revealing and concealment)的概念是seamful design的核心,因为它将形式和功能联系起来,而对这种联系的理解可以促进反思性思维。因此,Seamful explanations战略性地揭示了系统的缺陷和承受力,并掩盖了那些分散注意力的信息,对它们的认识可以促进有用的反思。

在组织层面上,为设计者和终端用户引入教育(培训)计划。搭建一个生态系统是很重要的,因为EPs具有社会维度的复杂性,我们需要一种超越技术层面的策略。近期工作表明,对黑暗模式的扫盲可以促进自我反思和减轻危害。EPs扫盲计划可以制定如下:(a)帮助设计者意识到EPs可能出现的表现;(b)让终端用户提高识别“陷阱”的能力。

总的来说,这些策略有助于我们用积极地预防EPs,促进对陷阱的复原力。虽然不够详尽和规范,但它在解决潜在有害问题上迈出了重要的一步。

从安全性和可靠性的角度来说,XAI系统对人工智能解释所产生的影响进行分类非常重要。这项研究通过“可解释性陷阱(EPs)”概念的讨论,揭露了人工智能解释可能带来的意料之外的负面影响。文中关于EPs的操作化和应对策略的解读和见解,有助于改善XAI系统的问责和安全机制。

基于这项研究发现,作者认为关于XAI还有一些开放性的问题值得进一步讨论:

1. 如何制定有效的 EPs 分类法,以更好地识别和减少负面影响?

2. 如何使用不恰当解释来说明“陷阱”在现实中的影响?

3. 如何评估训练过程,以减轻“陷阱”可能带来的影响

最后作者表示,从人机交互到人工智能社区,他们正在通过基础概念与应用进一步研究可解释性陷阱。相信通过了解XAI系统中陷阱的位置、方式和原因,可以显著提高人工智能系统的安全性。

雷锋网

论文地址://arxiv.org/pdf/2109.12480.pdf

论文地址://arxiv.org/pdf/2109.12480.pdf